linux user pwn 基础知识

环境搭建

虚拟机安装

- 镜像下载网站

- 为了避免环境问题建议 22.04 ,20.04,18.04,16.04 等常见版本 ubuntu 虚拟机环境各准备一份。注意定期更新快照以防意外。

- 虚拟机建议硬盘 256 G 以上,内存也尽量大一些。硬盘大小只是上界,256 G 不是真就占了 256 G,而后期如果硬盘空间不足会很麻烦。

- 更换 ubuntu 镜像源 ,建议先在

系统设置 → Software & Updates → Download from → 选择国内服务器例如阿里云(貌似不这样后续换源会出错),然后再sudo gedit /etc/apt/sources.list将镜像源中不高于当前系统版本的镜像复制进去(高于当前系统版本容易把apt搞坏)。 - Ubuntu 换源 error:The following signatures couldn’t be verified because the public key is not available 解决方法:

sudo apt-key adv --keyserver keyserver.ubuntu.com --recv-keys 5523BAEEB01FA116其中的5523BAEEB01FA116是根据错误提示写的。

基础工具

net-tools

ifconfig 查看网络配置需要安装 net-tools 。

1 | sudo apt install net-tools |

vim

1 | sudo apt install vim |

gedit

不习惯 vim 的可以使用 gedit 文本编辑器。

1 | sudo apt install gedit |

git

1 | sudo apt install git |

gcc

1 | sudo apt install gcc |

python

ipython 提供了很好的 python 交互命令行,建议安装。

1 | sudo apt install python2 |

另外有的版本 ubuntu 的不好安装 pip2 可以使用 get-pip.py 脚本安装。

1 | sudo apt install python3-pip |

ubuntu 22.04 的 ipython(python2)必须使用 pip2 安装:

1 | sudo pip2 install ipython |

docker

1 | sudo apt install docker.io |

默认情况下,Docker 命令需要使用 sudo 权限才能运行,这是因为 Docker 守护进程以 root 用户身份运行。然而,你可以通过以下步骤将当前用户添加到 Docker 用户组,从而允许在不使用 sudo 的情况下运行 Docker 命令:

确保当前用户属于

docker组:运行以下命令检查当前用户是否已添加到 docker 组:1

groups

在输出的组列表中查找

docker。如果没有找到docker组,请继续下一步。将当前用户添加到

docker组:运行以下命令将当前用户添加到docker组中(将<username>替换为你的用户名):1

sudo usermod -aG docker <username>

更新用户组更改:运行以下命令使用户组更改生效:

1

newgrp docker

重新登录或重启系统:要使用户组更改永久生效,你需要注销当前会话并重新登录,或者重启系统。

oh-my-zsh

安装 zsh

1 | sudo apt install zsh |

安装 oh-my-zsh

1 | sh -c "$(curl -fsSL https://raw.githubusercontent.com/ohmyzsh/ohmyzsh/master/tools/install.sh)" |

设置 zsh 为默认 shell(重启虚拟机后生效)

1 | chsh -s /bin/zsh |

安装 oh-my-zsh 插件 zsh-autosuggestions ,zsh-syntax-highlighting

1 | git clone https://github.com/zsh-users/zsh-autosuggestions ${ZSH_CUSTOM:-~/.oh-my-zsh/custom}/plugins/zsh-autosuggestions |

编辑 ~/.zshrc 添加插件:

1 | plugins=( |

更新:

1 | omz update |

wsl

WSL (Windows Subsystem for Linux) 是微软为 Windows 用户提供的一种兼容层,允许用户在 Windows 操作系统上运行 Linux 环境(包括大部分命令行工具、应用程序和服务),而不需要安装虚拟机或双系统。简单来说,WSL 让你在 Windows 上运行 Linux 程序,就像它们是原生程序一样。

WSL 目前有 WSL1 和 WSL2 两个版本:

WSL1 :最初的版本,提供 Linux 环境,运行 Linux 程序,速度较快但功能较有限。

WSL2 :通过在 Windows 上虚拟化完整的 Linux 内核,提供更强大的功能和更高的兼容性,特别适合需要容器、Docker 或更复杂的 Linux 功能的开发工作。

由于 WSL2 和虚拟机的部分设置冲突,因此这里建议安装 WSL1。具体安装过程如下:

安装 WSL 1 或 WSL 2 : 你可以通过 PowerShell 运行以下命令来安装 WSL:

1

wsl --install

选择 Linux 发行版 : 安装后,你可以从 Microsoft Store 下载你喜欢的 Linux 发行版(如 Ubuntu、Debian 等)。我这里安装的是 Ubuntu 22.04。

启用 Windows 功能 :下载好 Linux 发行版后在应用商店选择打开该 Linux,此时会弹出系统安装的命令窗口。但正常情况下这一步会出现一些报错,你需要启用部分 Windows 功能来避免这些报错。

0x80370114 错误 :这个报错说明未启用“虚拟机平台 (Virtual Machine Platform)”或“Windows 子系统 for Linux”功能。你需要打开 PowerShell(以管理员身份运行),依次执行以下命令并重启电脑:

1

2dism.exe /online /enable-feature /featurename:Microsoft-Windows-Subsystem-Linux /all /norestart

dism.exe /online /enable-feature /featurename:VirtualMachinePlatform /all /norestart0x80370102 错误 :这个报错表示虚拟化功能未启用,或者 Windows 中的 虚拟机平台 (Virtual Machine Platform) 功能未启用。

如果是安装 WSL2 则需要打开 PowerShell(以管理员身份运行),然后执行以下命令开启 Hyper-V 功能并重启电脑。

1

dism.exe /online /enable-feature /featurename:Microsoft-Hyper-V-All /all /norestart

之后还要打开 任务管理器,切换到“性能”选项卡,选择“CPU”,查看右下角“虚拟化”是否显示为 已启用。如果未启用还要在重启的时候进 BIOS 开启 CPU 的虚拟化选项。

如果是安装 WSL1 则只需要将 WSL 的版本设置为 1 即可。

1

wsl --set-default-version 1

解决 WSL 中 DNS 炸的问题:

1 | sudo bash -c 'cat > /etc/resolv.conf <<EOF |

pwn 相关工具

clion

clion 是一款 C\C++ 的 IDE ,可以用来阅读 glibc 源码的工具,这款工具对宏展开,符号跳转,结构体大小以及成员偏移计算都有很好的支持。这款软件需要付费使用,不过可以某宝搞一个教育邮箱。

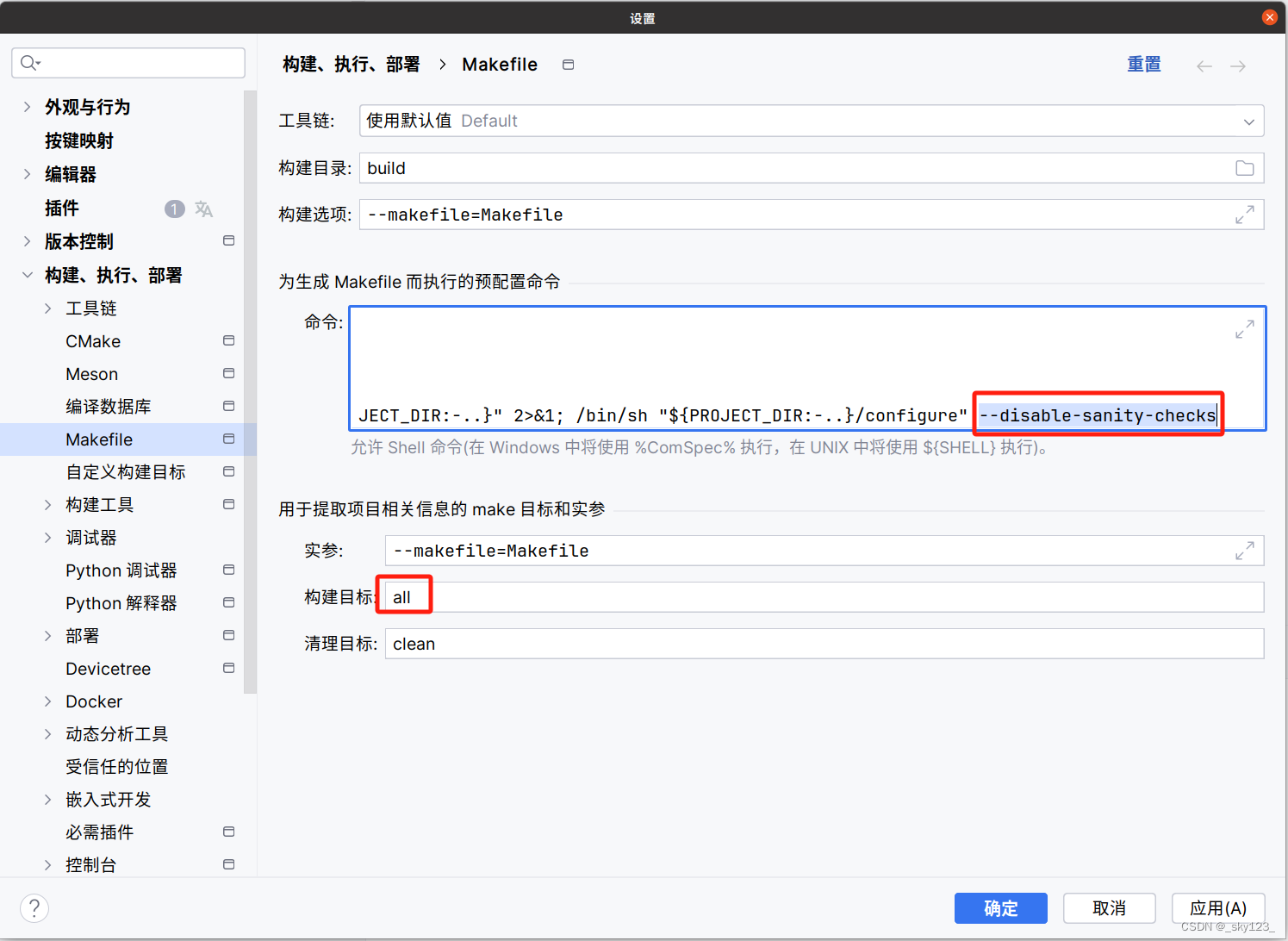

首先用打开 debug_glibc 解压后的 glibc 源码,这里有以下几点需要注意:

- 源码在对应版本的

source目录下。 - 最好不要使用解压到默认

\glibc路径下的源码,因为源码调试与行号绑定,阅读源码可能会修改到源码。 - 这里用

debug_glibc中的源码是因为这里的源码是编译过的,clion 分析代码需要编译的配置文件。

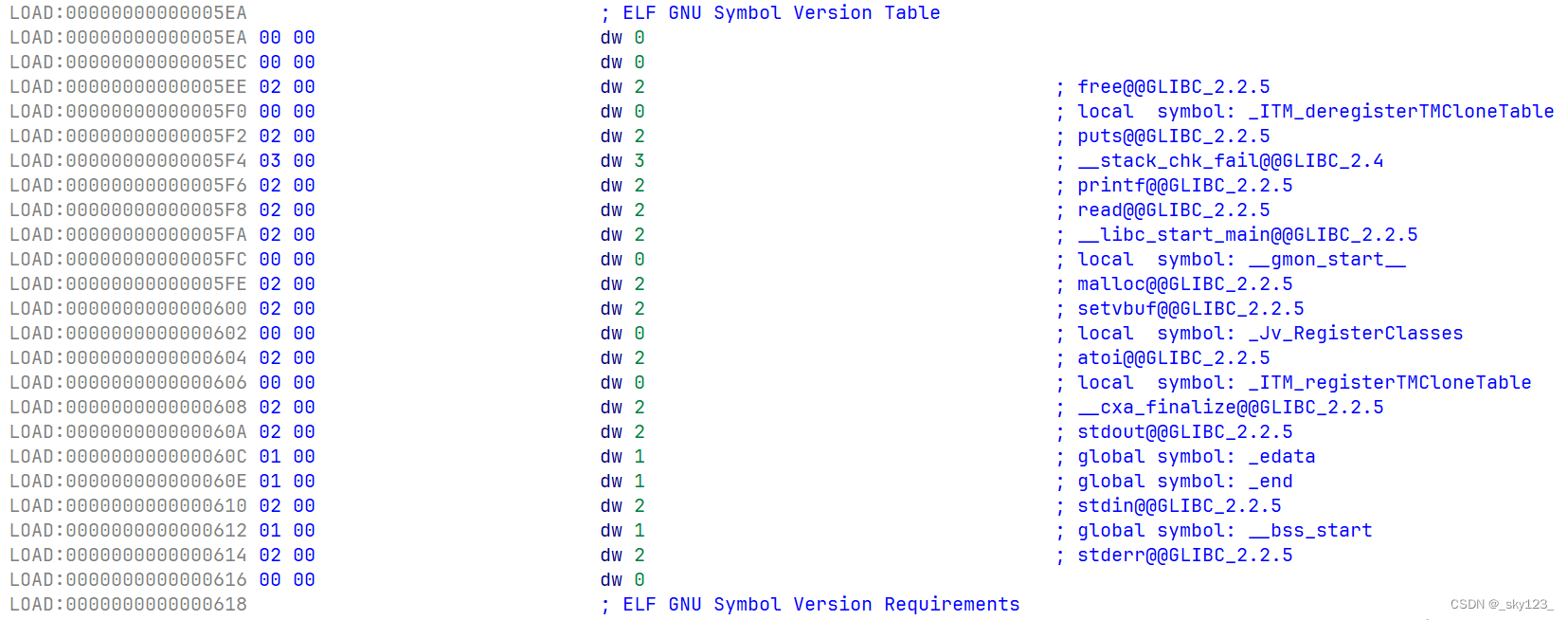

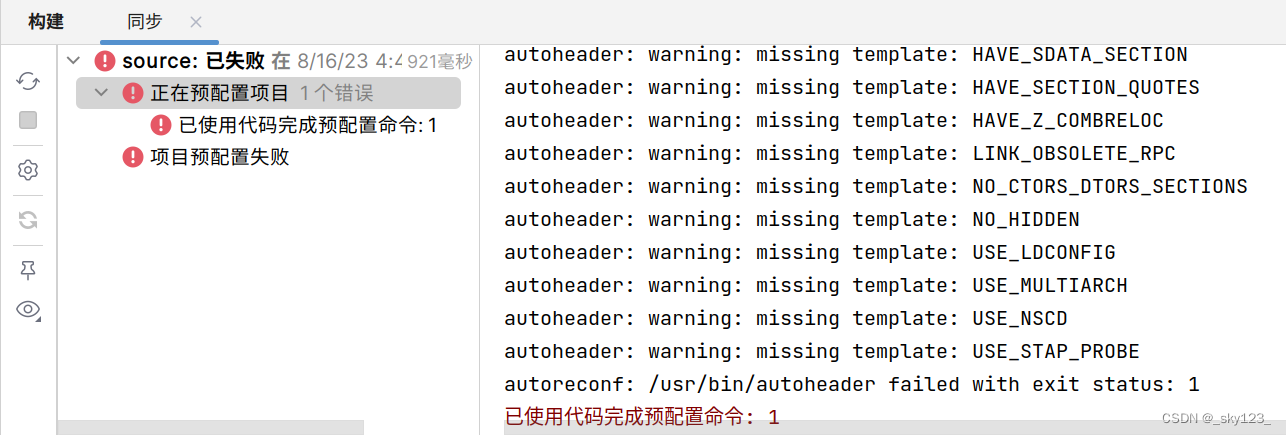

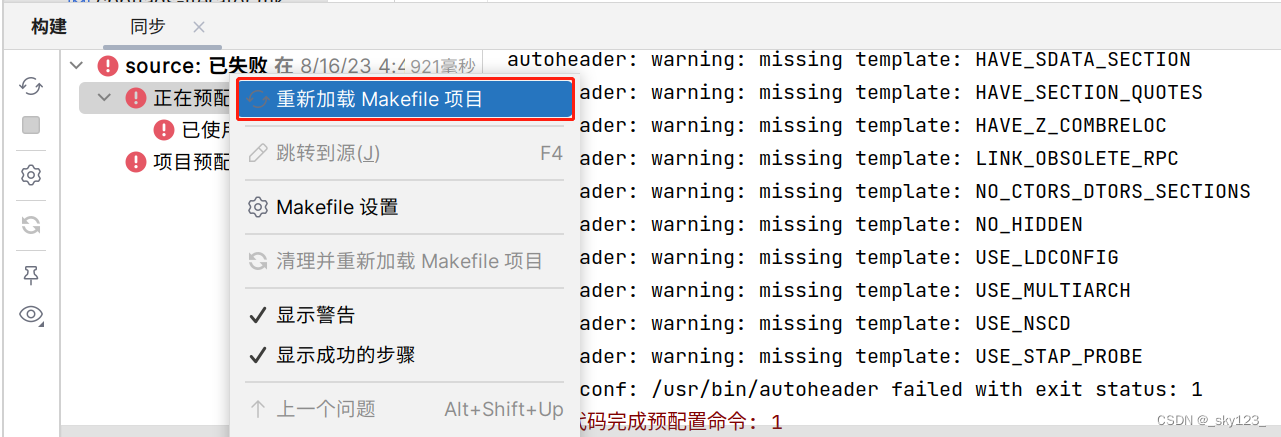

然后这里我们看到 Makefile 没有正确导入:

在较新版本的 clion 中位于 source 根目录下的 autoreconf 的配置文件 configure.ac 配置有问题,需要改成以下内容(这个主要看版本,有时默认的就好使):

1 | GLIBC_PROVIDES dnl See aclocal.m4 in the top level source directory. |

另外还需要右键 Makefile 设置在命令后面添加 --disable-sanity-checks 。另外构建目标要填 all ,否则 clion 分析的源码的不全。

完整预配置命令如下:

1 |

|

之后右键重新加载 Makefile 项目。

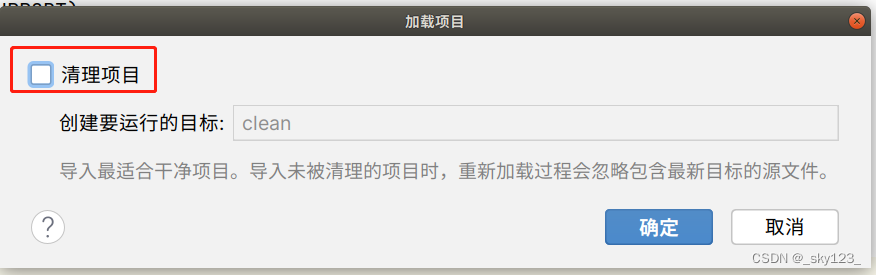

不勾选清理项目。

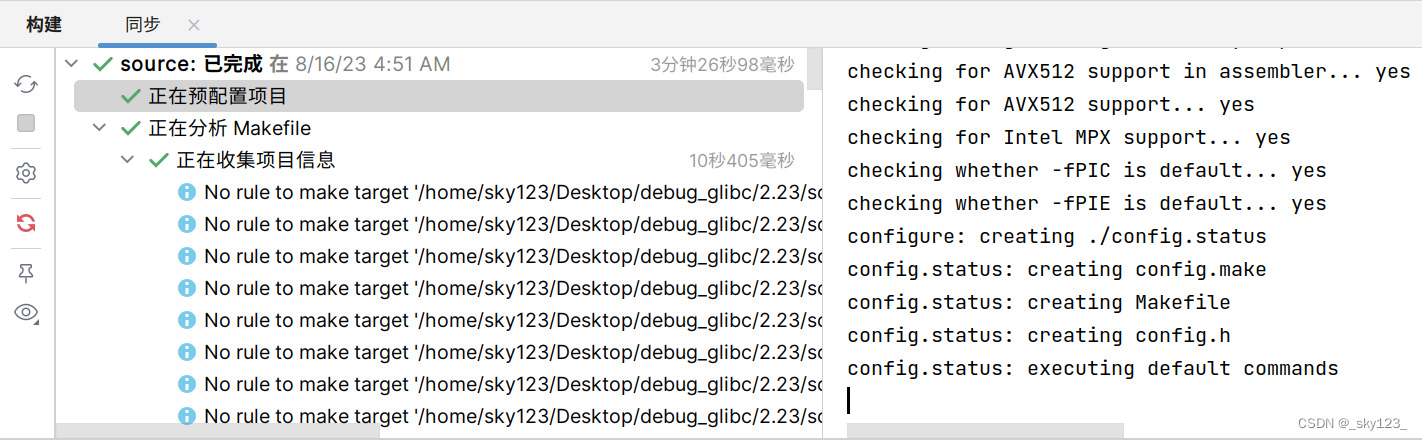

如果最后这样说明导入成功,之后耐心等待项目导入完毕即可。

gdb

1 | sudo apt-get install gdb gdb-multiarch |

主要有 pwndbg,peda,gef ,这里我常用的是 pwndbg 。对于一些版本过于古老导致环境装不上的可以尝试一下 peda 。

先将三个项目的代码都拉取下来。

1 | git clone https://github.com/longld/peda.git |

pwndbg 需要运行初始化脚本。

1 | cd pwndbg |

setup.sh慢/超时主要是两段:

pip install uv默认去pypi.org拉 20+MB 的 wheel,在国内经常很慢;清华 TUNA 这类镜像可以用.../simple来加速(simple不能少,而且要用 https)。- 后面的

uv sync也默认走 PyPI;而且 uv 不会自动沿用 pip 的镜像配置,需要单独给 uv 配 index(例如UV_DEFAULT_INDEX/UV_INDEX_URL),并且可以通过UV_HTTP_TIMEOUT/UV_HTTP_RETRIES调大超时与重试来缓解慢网超时。下面是把

setup.sh改成支持一键使用国内 PyPI 镜像的完整版本(同时把一开始那个 “Error: ‘uv’ binary not found.” 的噪音也抑制掉了;它本来只是common.sh早于 venv 创建而已,不是致命错误)。

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129

130

131

132

133

134

135

136

137

138

139

140

141

142

143

144

145

146

147

148

149

150

151

152

153

154

155

156

157

158

159

160

161

162

163

164

165

166

167

168

169

170

171

172

173

174

175

176

177

178

179

180

181

182

183

184

185

186

187

188

189

190

191

192

193

194

195

196

197

198

199

200

201

202

203

204

205

206

207

208

209

210

211

212

213

214

215

216

217

218

219

220

221

222

223

224

225

226

227

228

229

230

231

232

233

234

235

236

237

238

239

240

241

242

243

244

245

246

247

248

249

250

251

252

253

254

255

256

257

258

259

260

261

262

263

264

265

266

267

268

269

270

271

272

273

274

275

276

277

278

279

280

281

282

283

284

285

286

287

288

289

290

291

292

293

294

295

296

297

298

299

300

301

302

303

304

305

306

307

308

309

310

311

312

313

314

315

316

317

318

319

320

321

322

323

324

325

326

327

328

329

330

331

332

333

334

335

336

337

338

339

340

341

342

343

344

345

346

347

348

349

350

351

352

353

354

355

356

357

358

359

360

361

362

363

364

365

366

367

368

369

370

371

372

373

374

375

376

377

378

379

380

381

382

383

384

385

386

387

388

389

390

391

392

393

394

395

396

397

398

399

400

401

402

403

404

405

406

407

408

409

410

411

412

413

414

415

416

417

418

419

420

421

422

423

set -e

# -----------------------------

# Pwndbg dev setup helper (patched for CN mirrors)

#

# New flags:

# --cn Use a China-friendly PyPI mirror for BOTH pip (uv install) and uv (uv sync)

# --pypi-mirror URL Override the PyPI/simple index URL (works with --cn too)

# --cn-apt (Ubuntu only) Switch archive.ubuntu.com -> a CN Ubuntu mirror (backup first)

# --cn-apt-security (Ubuntu only) Also switch security.ubuntu.com -> the CN mirror (NOT recommended on prod)

# --apt-mirror URL Override the Ubuntu mirror base (Ubuntu only; used with --cn-apt*)

# --update Same as upstream: do not touch ~/.gdbinit

#

# You can also configure mirrors via environment variables:

# PWNDBG_PYPI_MIRROR="https://pypi.tuna.tsinghua.edu.cn/simple"

# PWNDBG_APT_MIRROR="https://mirrors.tuna.tsinghua.edu.cn/ubuntu"

# UV_HTTP_TIMEOUT=600 UV_HTTP_RETRIES=10 (optional)

#

# -----------------------------

SCRIPT_DIR="$(cd "$(dirname "$0")" && pwd)"

# The upstream scripts/common.sh prints "Error: 'uv' binary not found." before we create the venv.

# That's harmless but confusing. We temporarily set PWNDBG_NO_UV=1 while sourcing, to silence it.

__OLD_PWNDBG_NO_UV="${PWNDBG_NO_UV-}"

export PWNDBG_NO_UV=1

# shellcheck source=/dev/null

source "${SCRIPT_DIR}/scripts/common.sh"

if [[ -n "${__OLD_PWNDBG_NO_UV}" ]]; then

export PWNDBG_NO_UV="${__OLD_PWNDBG_NO_UV}"

else

unset PWNDBG_NO_UV

fi

unset __OLD_PWNDBG_NO_UV

# If we are root in a container and `sudo` doesn't exist, overwrite sudo with a passthrough.

if ! hash sudo 2> /dev/null && whoami | grep -q root; then

sudo() { ${*}; }

fi

# Helper functions

linux() { uname | grep -iqs Linux; }

osx() { uname | grep -iqs Darwin; }

# -----------------------------

# Mirror helpers (CN-friendly)

# -----------------------------

DEFAULT_CN_PYPI_MIRROR="https://pypi.tuna.tsinghua.edu.cn/simple"

DEFAULT_CN_UBUNTU_MIRROR="https://mirrors.tuna.tsinghua.edu.cn/ubuntu"

USE_CN_MIRROR=0

USE_CN_APT=0

USE_CN_APT_SECURITY=0

# Allow overriding via environment variables

PWNDBG_PYPI_MIRROR="${PWNDBG_PYPI_MIRROR-}"

PWNDBG_APT_MIRROR="${PWNDBG_APT_MIRROR-}"

# Derived pip options (only used for installing uv with pip)

PIP_TIMEOUT="${PIP_TIMEOUT-120}"

PIP_RETRIES="${PIP_RETRIES-10}"

# Derived uv options (only used when --cn is enabled unless user sets them externally)

UV_HTTP_TIMEOUT_DEFAULT="${UV_HTTP_TIMEOUT-600}"

UV_HTTP_RETRIES_DEFAULT="${UV_HTTP_RETRIES-10}"

get_host_from_url() {

# Extract host from a URL like https://example.com/path -> example.com

echo "$1" | sed -E 's@^[a-zA-Z]+://([^/]+)/?.*$@\1@'

}

enable_python_mirror_env() {

# Configure uv to use a custom index (mirror) + safer timeout/retry defaults.

# uv supports UV_DEFAULT_INDEX / UV_INDEX_URL and UV_HTTP_TIMEOUT / UV_HTTP_RETRIES. (Docs: Astral uv)

local mirror_url="$1"

export UV_DEFAULT_INDEX="${mirror_url}"

# Backwards compatibility for older uv (deprecated but still recognized):

export UV_INDEX_URL="${mirror_url}"

# Avoid random timeouts on slow links

export UV_HTTP_TIMEOUT="${UV_HTTP_TIMEOUT_DEFAULT}"

export UV_HTTP_RETRIES="${UV_HTTP_RETRIES_DEFAULT}"

# For pip (used only to fetch the 'uv' wheel into the venv)

export PIP_DEFAULT_TIMEOUT="${PIP_TIMEOUT}"

export PIP_DISABLE_PIP_VERSION_CHECK=1

}

apply_ubuntu_apt_mirror() {

# Only for Ubuntu, and only when user explicitly asked via --cn-apt / --cn-apt-security.

local mirror_base="$1" # e.g. https://mirrors.tuna.tsinghua.edu.cn/ubuntu

local also_security="$2" # 0/1

local files=()

[[ -f /etc/apt/sources.list ]] && files+=("/etc/apt/sources.list")

[[ -f /etc/apt/sources.list.d/ubuntu.sources ]] && files+=("/etc/apt/sources.list.d/ubuntu.sources")

if [[ ${#files[@]} -eq 0 ]]; then

echo "[!] No Ubuntu APT source file found to patch. Skipping APT mirror change."

return 0

fi

echo "[*] Applying Ubuntu APT mirror: ${mirror_base}"

if [[ "${also_security}" == "1" ]]; then

echo "[!] NOTE: You enabled switching *security* updates to the mirror."

echo " Mirrors may lag behind official security updates; consider leaving security.ubuntu.com unchanged on production machines."

fi

for f in "${files[@]}"; do

# Backup once

if [[ ! -f "${f}.pwndbg.bak" ]]; then

sudo cp -a "${f}" "${f}.pwndbg.bak" || true

echo "[*] Backup created: ${f}.pwndbg.bak"

fi

# Replace archive.ubuntu.com (and regional variants like xx.archive.ubuntu.com)

sudo sed -i \

-e "s@http://archive.ubuntu.com/ubuntu@${mirror_base}@g" \

-e "s@https://archive.ubuntu.com/ubuntu@${mirror_base}@g" \

-e "s@http://[a-z][a-z]\\.archive.ubuntu.com/ubuntu@${mirror_base}@g" \

-e "s@https://[a-z][a-z]\\.archive.ubuntu.com/ubuntu@${mirror_base}@g" \

"${f}" || true

if [[ "${also_security}" == "1" ]]; then

sudo sed -i \

-e "s@http://security.ubuntu.com/ubuntu@${mirror_base}@g" \

-e "s@https://security.ubuntu.com/ubuntu@${mirror_base}@g" \

"${f}" || true

fi

done

}

# -----------------------------

# Package manager installers

# -----------------------------

install_apt() {

sudo apt-get update || true

sudo apt-get install -y git gdb gdbserver python3-dev python3-venv python3-setuptools

sudo apt-get install -y libc6-dbg

}

install_dnf() {

sudo dnf update || true

sudo dnf -y install git gdb gdb-gdbserver python3-devel

sudo dnf -y debuginfo-install glibc

}

install_xbps() {

sudo xbps-install -Su

sudo xbps-install -Sy gdb gcc python-devel python3-devel glibc-devel make curl

sudo xbps-install -Sy glibc-dbg

}

install_swupd() {

sudo swupd update || true

sudo swupd bundle-add gdb python3-basic make c-basic curl

}

install_zypper() {

sudo zypper mr -e repo-oss-debug || sudo zypper mr -e repo-debug

sudo zypper refresh || true

sudo zypper install -y gdb gdbserver python-devel python3-devel glib2-devel make glibc-debuginfo curl

sudo zypper install -y python2-pip || true # skip py2 installation if it doesn't exist

if uname -m | grep -q x86_64; then

sudo zypper install -y glibc-32bit-debuginfo || true

fi

}

install_emerge() {

sudo emerge --oneshot --deep --newuse --changed-use --changed-deps dev-lang/python dev-debug/gdb

}

install_oma() {

sudo oma refresh || true

sudo oma install -y gdb python-3 glib make glibc-dbg curl

if uname -m | grep -q x86_64; then

sudo oma install -y glibc+32-dbg || true

fi

}

install_pacman() {

read -p "Do you want to do a full system update? (y/n) [n] " answer

# user want to perform a full system upgrade

answer=${answer:-n} # n is default

if [[ "$answer" == "y" ]]; then

sudo pacman -Syu || true

fi

sudo pacman -S --noconfirm --needed git gdb python which debuginfod curl

if [ -z "$UPDATE_MODE" ]; then

if ! grep -qs "^set debuginfod enabled on" ~/.gdbinit; then

echo "set debuginfod enabled on" >> ~/.gdbinit

echo "[*] Added 'set debuginfod enabled on' to ~/.gdbinit"

fi

fi

}

install_freebsd() {

sudo pkg install git gdb python py39-pip cmake gmake curl

which rustc || sudo pkg install rust

}

usage() {

echo "Usage: $0 [--update] [--cn] [--pypi-mirror URL] [--cn-apt] [--cn-apt-security] [--apt-mirror URL]"

echo ""

echo " --cn Use a CN PyPI mirror for pip+uv (default: ${DEFAULT_CN_PYPI_MIRROR})"

echo " --pypi-mirror URL Override the PyPI/simple index URL used for --cn"

echo " --cn-apt (Ubuntu) Switch archive.ubuntu.com -> CN Ubuntu mirror (backup first)"

echo " --cn-apt-security (Ubuntu) Also switch security.ubuntu.com -> mirror (NOT recommended on prod)"

echo " --apt-mirror URL Override Ubuntu mirror base (default: ${DEFAULT_CN_UBUNTU_MIRROR})"

echo " --update Install/update deps without checking ~/.gdbinit"

echo ""

echo "Env vars (optional):"

echo " PWNDBG_PYPI_MIRROR, PWNDBG_APT_MIRROR, UV_HTTP_TIMEOUT, UV_HTTP_RETRIES, PIP_TIMEOUT, PIP_RETRIES"

}

UPDATE_MODE=

while [[ $# -gt 0 ]]; do

case "$1" in

--update)

UPDATE_MODE=1

shift

;;

--cn)

USE_CN_MIRROR=1

shift

;;

--pypi-mirror)

if [[ $# -lt 2 ]]; then

echo "Missing value for --pypi-mirror"

exit 1

fi

PWNDBG_PYPI_MIRROR="$2"

shift 2

;;

--cn-apt)

USE_CN_APT=1

shift

;;

--cn-apt-security)

USE_CN_APT=1

USE_CN_APT_SECURITY=1

shift

;;

--apt-mirror)

if [[ $# -lt 2 ]]; then

echo "Missing value for --apt-mirror"

exit 1

fi

PWNDBG_APT_MIRROR="$2"

shift 2

;;

-h | --help)

usage

exit 0

;;

*)

echo "Unknown argument: $1"

usage

exit 1

;;

esac

done

PYTHON=''

if osx; then

echo "Not supported on macOS. Please use one of the alternative methods listed at:"

echo "https://pwndbg.re/dev/contributing/setup-pwndbg-dev/"

exit 1

fi

# Decide mirror URLs

if [[ "${USE_CN_MIRROR}" == "1" && -z "${PWNDBG_PYPI_MIRROR}" ]]; then

PWNDBG_PYPI_MIRROR="${DEFAULT_CN_PYPI_MIRROR}"

fi

if [[ "${USE_CN_APT}" == "1" && -z "${PWNDBG_APT_MIRROR}" ]]; then

PWNDBG_APT_MIRROR="${DEFAULT_CN_UBUNTU_MIRROR}"

fi

# Apply mirror env early (affects pip + uv later)

if [[ "${USE_CN_MIRROR}" == "1" ]]; then

echo "[*] Using CN PyPI mirror for pip+uv: ${PWNDBG_PYPI_MIRROR}"

enable_python_mirror_env "${PWNDBG_PYPI_MIRROR}"

fi

if linux; then

distro=$(grep "^ID=" /etc/os-release | cut -d'=' -f2 | sed -e 's/\"//g')

case $distro in

"ubuntu")

if [[ "${USE_CN_APT}" == "1" ]]; then

apply_ubuntu_apt_mirror "${PWNDBG_APT_MIRROR}" "${USE_CN_APT_SECURITY}"

fi

install_apt

;;

"fedora")

install_dnf

;;

"clear-linux-os")

install_swupd

;;

"opensuse-leap" | "opensuse-tumbleweed")

install_zypper

;;

"arch" | "archarm" | "endeavouros" | "manjaro" | "garuda" | "cachyos" | "archcraft" | "artix")

install_pacman

echo "Logging off and in or conducting a power cycle is required to get debuginfod to work."

echo "Alternatively you can manually set the environment variable: DEBUGINFOD_URLS=https://debuginfod.archlinux.org"

;;

"void")

install_xbps

;;

"gentoo")

install_emerge

;;

"freebsd")

install_freebsd

;;

"aosc")

install_oma

;;

*) # we can add more install command for each distros.

echo "\"$distro\" is not supported distro. Will search for 'apt', 'dnf' or 'pacman' package managers."

if hash apt; then

install_apt

elif hash dnf; then

install_dnf

elif hash pacman; then

install_pacman

else

echo "\"$distro\" is not supported and your distro don't have a package manager that we support currently."

exit 2

fi

;;

esac

fi

if ! hash gdb; then

echo "Could not find gdb in $PATH"

exit 3

fi

# Find the Python used in compilation by GDB.

PYVER=$(gdb -batch -q --nx -ex 'pi import sysconfig; print(sysconfig.get_config_var("VERSION"))')

PYTHON=$(gdb -batch -q --nx -ex 'pi import sysconfig; print(sysconfig.get_config_vars().get("EXENAME", sysconfig.get_config_var("BINDIR")+"/python"+sysconfig.get_config_var("VERSION")+sysconfig.get_config_var("EXE")))')

if [ ! -x "$PYTHON" ]; then

echo "Error: '$PYTHON' does not exist or is not executable."

echo ""

echo "It looks like GDB is using a different Python version than the one installed via the package manager."

echo ""

echo "Possible solutions:"

echo " 1. Try installing 'python$PYVER' manually using your package manager."

echo " Example (for Debian/Ubuntu/Kali): 'sudo apt install python$PYVER'"

echo " Example (for Fedora/RHEL): 'sudo dnf install python$PYVER'"

echo " 2. Verify your GDB configuration and ensure it supports the correct Python version."

echo ""

echo "After making the necessary changes, rerun ./setup.sh"

exit 1

fi

# Check python version supported: <3.10, 3.99>

is_supported=$(echo "$PYVER" | grep -E '3\.(10|11|12|13|14|15|16|17|18|19|[2-9][0-9])' || true)

if [[ -z "$is_supported" ]]; then

echo "Your system has unsupported python version. Please use older pwndbg release:"

echo "'git checkout 2024.08.29' - python3.8, python3.9"

echo "'git checkout 2023.07.17' - python3.6, python3.7"

exit 4

fi

# Create the python virtual environment

echo "Creating virtualenv in path: ${PWNDBG_VENV_PATH}"

${PYTHON} -m venv -- ${PWNDBG_VENV_PATH}

# Activate venv

# shellcheck source=/dev/null

source "${PWNDBG_VENV_PATH}/bin/activate"

# Install uv inside the venv (use mirror if enabled)

echo "Installing uv into venv..."

if [[ "${USE_CN_MIRROR}" == "1" ]]; then

python -m pip install --upgrade uv \

--index-url "${PWNDBG_PYPI_MIRROR}" \

--timeout "${PIP_TIMEOUT}" \

--retries "${PIP_RETRIES}"

else

python -m pip install --upgrade uv

fi

UV_BIN="${PWNDBG_VENV_PATH}/bin/uv"

if [[ ! -x "${UV_BIN}" ]]; then

# fallback, but normally venv/bin/uv should exist

if command -v uv > /dev/null 2>&1; then

echo "Warning: Falling back to 'uv' found in PATH." >&2

UV_BIN="$(command -v uv)"

else

echo "Error: 'uv' not found after installation. Check your pip/venv setup." >&2

exit 5

fi

fi

# Install dependencies

echo "Installing dependencies.."

# uv will use UV_DEFAULT_INDEX / UV_HTTP_TIMEOUT / UV_HTTP_RETRIES if exported above.

"${UV_BIN}" sync --extra gdb --extra lldb --quiet

if [ -z "$UPDATE_MODE" ]; then

if grep -qs '^[^#]*source.*pwndbg/gdbinit.py' ~/.gdbinit; then

echo 'Pwndbg is already sourced in ~/.gdbinit .'

else

# Load Pwndbg into GDB on every launch.

echo "source $PWD/gdbinit.py" >> ~/.gdbinit

echo "[*] Added 'source $PWD/gdbinit.py' to ~/.gdbinit so that Pwndbg will be loaded on every launch of GDB."

fi

echo "Please set the PWNDBG_NO_AUTOUPDATE environment variable to any value"

echo "to disable the automatic updating of dependencies when Pwndbg is loaded."

fi用法示例:

2

3

4

5

6

7

8

9

10

11

./setup.sh --cn

# 2) 自己指定 PyPI 镜像(例如阿里云)

./setup.sh --cn --pypi-mirror https://mirrors.aliyun.com/pypi/simple/

# 3) (可选)Ubuntu APT 也换源:只换 archive,不动 security(更稳妥)

./setup.sh --cn --cn-apt

# 4) (不建议生产机)连 security 源也换到镜像

./setup.sh --cn --cn-apt-security

gdb 在启动的时候会读取当前用户的主目录的 .gdbinit 文件进行 gdb 插件的初始化,通常来说使用默认的配置即可:

1 | source /home/sky123/tools/pwndbg/gdbinit.py |

注意

以普通用权限和管理员权限启动 gdb 时读取的 .gdbinit 文件的路径是不同的,普通权限读取的是 /home/<username>/.gdbinit 而管理员权限读取的是 /root/.gdbinit 。

pwndbg 安装 ghidra 插件可以支持代码反编译(

虽然没啥用)

安装

r2pipe库

下载安装 radere2 项目

2

3

cd radare2

sudo sys/install.sh下载编译安装 r2ghidra 项目

2

3

4

5

6

cd r2ghidra

sudo ./preconfigure

sudo ./configure

sudo make -j16

sudo make install

没有调试插件的时候可以使用下面这套命令应急。最好放到 ~/.gdbinit 文件,如果在命令行中使用则只能逐行粘贴。

1 | set pagination off |

pwntools

注意我这里的 pwntools 是 python2 版本的,需要指定为 4.9.0 ,因为高版本的 pwntools 已经不支持 python2 了(具体来说是高版本的 pwntools 必须依赖 unicorn 2.x.x ,而 unicorn 2.x.x 只支持 python3)。

1 | pip install pwntools==4.10.0 -i https://pypi.tuna.tsinghua.edu.cn/simple |

如果已经装了 pwntools 需要先卸载干净再重新安装,否则更改版本无效(最好不带 sudo 也来一遍确保卸载干净)。

1 | sudo pip2 uninstall pwntools |

这样安装的 pwntools 的 plt 功可能无法正常使用,需要手动安装 Unicorn 库。

1 | pip install unicorn==1.0.3 -i https://pypi.tuna.tsinghua.edu.cn/simple |

当然这样做的代价是一些特殊架构老版本的 pwntools 不支持,这时候最好换 python3 的 pwntools 。

gadget 搜索工具

ROPgdbget

安装:

1 | git clone https://github.com/JonathanSalwan/ROPgadget.git |

使用:

1 | ROPgadget --binary ntdll.dll > rop |

有时候 ROPgadget 会出现如下报错:

1 | ROPgadget --binary init_60D_fwf > rop |

此时需要重新安装 capstone:

1 | sudo pip uninstall capstone |

如果出现这个报错:

1 | ➜ ~ ROPgadget |

这里需要将 ROPGadget 安装目录下的 script 目录拷贝到 /home/ubuntu/.local/lib/python3.10/site-packages/ROPGadget-7.5.dist-info 中。

1 | cd ROPGadget |

ropper

ropper 可以和 ROPgadget 配合使用,因为有的 gadget 使用 ROPgadget 搜不到,例如 arm32 架构的 Thumb 模式 gadget。

安装:

在 pypi 的 ropper 官网上下载 ropper

运行安装脚本完成 ropper 安装

1

sudo python3 setup.py install

使用:

1

ropper --file ./pwn --nocolor > rop

one_gadget

用于搜索 libc 中能够实现 execve("/bin/sh", (char *[2]) {"/bin/sh", NULL}, NULL); 的效果的跳转地址,由于是采用特征匹配的方法,因此只能是在 libc 中查找。

安装:

1

2sudo apt install -y ruby ruby-dev

sudo gem install one_gadget使用:可以查找到 gadget 地址以及条件限制。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24➜ ~ one_gadget /lib/x86_64-linux-gnu/libc.so.6

0x50a37 posix_spawn(rsp+0x1c, "/bin/sh", 0, rbp, rsp+0x60, environ)

constraints:

rsp & 0xf == 0

rcx == NULL

rbp == NULL || (u16)[rbp] == NULL

0xebcf1 execve("/bin/sh", r10, [rbp-0x70])

constraints:

address rbp-0x78 is writable

[r10] == NULL || r10 == NULL

[[rbp-0x70]] == NULL || [rbp-0x70] == NULL

0xebcf5 execve("/bin/sh", r10, rdx)

constraints:

address rbp-0x78 is writable

[r10] == NULL || r10 == NULL

[rdx] == NULL || rdx == NULL

0xebcf8 execve("/bin/sh", rsi, rdx)

constraints:

address rbp-0x78 is writable

[rsi] == NULL || rsi == NULL

[rdx] == NULL || rdx == NULL如果

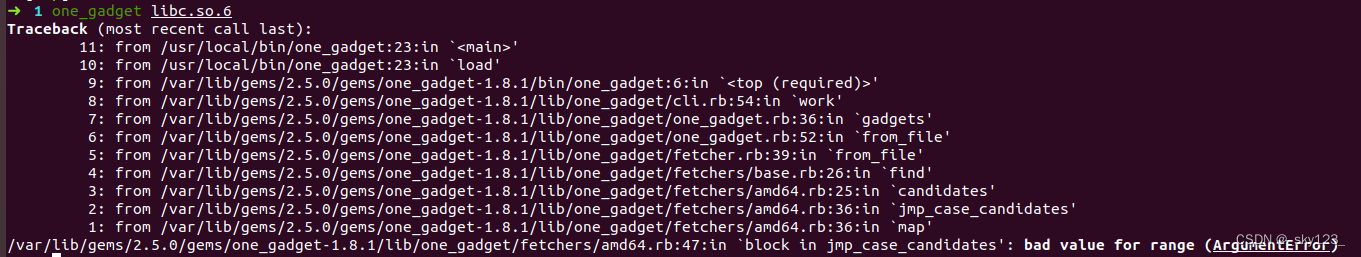

one_gadget在一个版本的 Ubuntu 中搜索某一版本的 glibc 的 gadget 出现如下报错可以尝试换另一个版本的 Ubuntu 。貌似是权限问题,可以以 root 权限重新装一下。

seccomp-tools

用于查看和生成程序沙箱规则。

安装:

1

sudo gem install seccomp-tools

使用:

1

seccomp-tools dump ./pwn

LibcSearcher

通过泄露的 libc 中函数的地址来确定 libc 版本。

1 | git clone https://github.com/lieanu/LibcSearcher.git |

glibc-all-in-one

临时找 glibc 和 ld 或者编译 glibc 。

1 | git clone https://github.com/matrix1001/glibc-all-in-one.git |

更新下载列表:

1 | ➜ glibc-all-in-one ./update_list |

下载 libc ,注意要安装解压工具 zstd ,因为下载脚本中用到了。

1 | sudo apt-get install zstd |

编译 libc

1 | sudo ./build [版本例如2.29] [架构例如 i686 amd64] |

patchelf

安装:

1 | sudo apt install patchelf |

qemu

1 | sudo apt install qemu-user qemu-system |

ELF 文件格式

ELF(Executable and Linkable Format)是一种通用的目标文件 / 可执行文件格式,是 System V ABI 的一部分,目前在多数类 Unix 系统(Linux、*BSD、Solaris 等)上作为标准的二进制格式,用于:

- 可执行文件(executable)

- 可重定位目标文件(object file)

- 共享对象(shared object / shared library)

- 核心转储文件(core dump)

在 ELF/ABI 里的 System V ABI 即 System V Application Binary Interface,这是一个规范文档,最早是在 UNIX System V / SVR4 体系下制定的;

这里的 UNIX System V 是历史上的 UNIX System V 操作系统;

其中 System V Release 4(SVR4) 是一个重要版本:

- 把很多特性(包括 ELF 格式、共享库、System V IPC 等)标准化;

- 影响了后来的很多类 Unix 系统,包括 Solaris、现代 Linux 的很多接口习惯。

今天你经常看到的几个词:

- SysV IPC:System V 风格的进程间通信(

shmget/semget/msgget等);- SysV init:老式的

/etc/init.drc*.d那一套 init 系统;- System V shared libraries:早期 SysV 提出的共享库机制(后发展为 ELF 动态链接)。

这些“SysV”大多就是从那个时代的 UNIX System V 演化来的。

它定义了很多东西“在二进制层面究竟长啥样”:

- ELF 文件格式(头、节、程序头、重定位、动态链接等);

- 调用约定(函数参数怎么压栈、寄存器怎么用);

- 动态链接行为、重定位类型、符号解析规则;

- 等等。

Linux、glibc、GCC、binutils 这些主流工具链,基本都是:

- 在 System V ABI 这套规范的基础上;

- 再加上一些各自的扩展(比如

.gnu.hash、.eh_frame、TLS、CET 等)。所以当我们说:

- “System V 风格 ELF”

- “遵循 System V ABI 的 x86‑64 Linux”

- “System V i386 ABI 规定了 R_386_32 / R_386_PC32 等重定位类型”

指的就是:

这是按 System V ABI 那套规则来玩 ELF 和动态链接的,

而不是别的什么私有格式(比如 Windows 的 PE/COFF,macOS 的 Mach‑O 等)。

ELF 头中的 e_type 字段描述该 ELF 文件的“对象类型”:

ET_REL(1)——可重定位文件(Relocatable file)- 编译器生成的中间目标文件,一般扩展名为 **

.o**。 - 不能直接执行,必须经过链接器处理,生成

ET_EXEC或ET_DYN。 - 静态库

.a并不是一种单独的 ELF 类型,而是一个 ar 归档文件,里面打包了多个ET_REL的 ELF 目标文件。

- 编译器生成的中间目标文件,一般扩展名为 **

ET_EXEC(2)——可执行文件(Executable file)- 传统意义上的“普通可执行程序”,装载基址一般是固定的(非 PIE)。

- 在现代 Linux 上,如果启用 PIE,主程序通常会使用

ET_DYN而不是ET_EXEC。

ET_DYN(3)——共享对象文件(Shared object file)- 最典型的是共享库,扩展名通常是 **

.so**(例如libc.so.6)。 - 同时,现代的 PIE(Position-Independent Executable)主程序 也经常是

ET_DYN:本质上就是“可以当主程序启动的共享对象”。

- 最典型的是共享库,扩展名通常是 **

ET_CORE(4)——核心转储文件(Core file)- 程序崩溃时,内核生成的内存快照,用于调试。

- 包含进程地址空间、寄存器等运行时状态。

除此之外,还有:

ET_NONE:无类型 / 未定义;ET_LOOS~ET_HIOS、ET_LOPROC~ET_HIPROC:保留给特定 OS / CPU 扩展使用。

ELF 规范同时定义了 32 位(ELFCLASS32)和 64 位(ELFCLASS64)两套结构。两者在整体布局上是兼容的:

同样都有:

- ELF 文件头

Elf32_Ehdr/Elf64_Ehdr - 程序头表

Elf32_Phdr/Elf64_Phdr - 节表

Elf32_Shdr/Elf64_Shdr

- ELF 文件头

大部分结构只是:

- 字段宽度不同(32 位地址 / 偏移 VS 64 位地址 / 偏移);

- 个别字段为保证对齐,顺序略有调整(例如

Elf64_Phdr中先是p_type、p_flags,再是 offset / addr 等)。

在 Linux 系统上,这些结构和相关常量通常由 <elf.h> 提供,头文件路径一般在 /usr/include/elf.h 或 C 库的专用 include 目录中。

elf.h 通过 typedef 定义了一组与具体平台无关的基础类型,用来描述 ELF 各种结构体中的字段。不同实现写法略有差别,但主流实现(glibc、Linux 内核、LLVM 等)的定义基本一致:

| 自定义类型 | 含义(语义) | 常见底层类型 | 长度(字节) |

|---|---|---|---|

Elf32_Addr |

32 位地址(虚拟地址) | uint32_t |

4 |

Elf32_Half |

16 位无符号整数 | uint16_t |

2 |

Elf32_Off |

32 位文件偏移 | uint32_t |

4 |

Elf32_Word |

32 位无符号整数 | uint32_t |

4 |

Elf32_Sword |

32 位有符号整数 | int32_t |

4 |

Elf64_Addr |

64 位地址(虚拟地址) | uint64_t |

8 |

Elf64_Half |

16 位无符号整数 | uint16_t |

2 |

Elf64_Off |

64 位文件偏移 | uint64_t |

8 |

Elf64_Word |

32 位无符号整数(仍为 32bit) | uint32_t |

4 |

Elf64_Sword |

32 位有符号整数(仍为 32bit) | int32_t |

4 |

说明:

Word/Sword并不是“跟随地址宽度扩成 64 位”,而是统一定义为 32 位整型;真正的 64 位整型在 ELF 里通常用

Xword/Sxword:

Elf32_Xword/Elf32_Sxword:在 32 位变体里偶尔用到;Elf64_Xword/Elf64_Sxword:64 位 ELF 中大量使用(如某些 size 字段)。

从整体结构上看,一个 ELF 文件大致由以下几部分组成:

ELF 文件头(ELF Header,

Elf*_Ehdr)出现在文件开头,包含:

- 魔数

\x7fELF和一些“识别信息”(位宽、大小端、ABI 等); - 文件类型

e_type、目标架构e_machine、版本e_version; - 程序入口

e_entry; - 程序头表偏移

e_phoff、节表偏移e_shoff; - 各表项大小 / 数量(

e_phentsize、e_phnum、e_shentsize、e_shnum)等。

- 魔数

程序头表(Program Header Table,

Elf*_Phdr,描述“段 Segment”)只有需要被装载执行的文件才真正用到(典型是

ET_EXEC、ET_DYN、ET_CORE);目标文件

ET_REL一般没有程序头表(规范允许有,但常见工具不会生成);每个

Elf*_Phdr描述一个 段(Segment):- 段类型

p_type(如PT_LOAD、PT_DYNAMIC、PT_INTERP等); - 文件偏移

p_offset、内存虚拟地址p_vaddr; - 文件中大小

p_filesz、内存中大小p_memsz; - 读 / 写 / 执行等权限标志

p_flags; - 对齐要求

p_align等。

- 段类型

段是面向“运行时装载”的视图:内核 / 动态链接器根据 Program Header 来决定如何把文件映射到进程的虚拟地址空间。

节表(Section Header Table,

Elf*_Shdr,描述“节 Section”)所有 ELF 文件(包含

ET_REL)都可以有节表,用于链接 / 调试等工具。每个

Elf*_Shdr描述一个 节(Section):- 节名索引

sh_name(指向.shstrtab); - 节类型

sh_type(如SHT_PROGBITS、SHT_SYMTAB、SHT_STRTAB、SHT_NOBITS等); - 标志

sh_flags(可写 / 可执行 / 是否占用内存等); - 文件偏移

sh_offset、大小sh_size; - 对齐

sh_addralign、表项大小sh_entsize(如符号表、重定位表)等。

- 节名索引

段与节的关系:

节(Section):

- 主要服务于 链接器 / 调试器 / 静态分析工具;

- 例如

.text、.data、.bss、.rodata、.symtab、.strtab、.rel.text等; - 一个文件可以有很多细粒度的节,每个节有清晰的类型、用途。

段(Segment):

- 主要服务于 运行时装载(内核、动态链接器);

- 典型的

PT_LOAD段会把若干具有相同权限属性(如R-X、RW-)的节“打包”进同一块连续的虚拟地址区间,以减少映射次数、简化权限设置。 - 段和节之间是 多对多的映射关系,并不是简单“若干属性相同的节合成一个段”,而是由链接脚本和链接器策略决定。

可以通俗地这么理解:

节 = 文件视图,偏重“这块数据是什么”;

段 = 运行时视图,偏重“这块数据如何被映射到内存、有什么权限”。

文件头

每个 ELF 文件开头都有一个 文件头(ELF Header),用于描述整个文件的基本属性和布局信息。无论是:

- 可重定位文件(

.o,ET_REL), - 可执行文件(

ET_EXEC), - 共享对象(

.so,ET_DYN), - 核心转储文件(

ET_CORE),

都必须以同一个 ELF 头结构开头。

以 32 位的 Elf32_Ehdr 为例(64 位的 Elf64_Ehdr 字段完全对应,只是类型宽度不同):

1 |

|

e_ident:魔数和基础属性e_ident是一个长度为 16 字节的数组,用来描述 ELF 文件的“标识信息”。各字节含义如下(用常见的宏名标号):1

2

3

4

5

6

7

8

9

10e_ident[EI_MAG0] = 0x7f;

e_ident[EI_MAG1] = 'E';

e_ident[EI_MAG2] = 'L';

e_ident[EI_MAG3] = 'F';

e_ident[EI_CLASS]; // 32/64 位

e_ident[EI_DATA]; // 字节序

e_ident[EI_VERSION]; // ELF 版本

e_ident[EI_OSABI]; // OS/ABI

e_ident[EI_ABIVERSION]; // ABI 版本

e_ident[EI_PAD..15]; // 填充/保留前 4 字节(

EI_MAG0~`EI_MAG3`) 固定为\x7f 'E' 'L' 'F',用来标识“这是一个 ELF 文件”。第 5 字节:

EI_CLASS表示 ELF 的 位宽类别(注意不是“文件类型”):ELFCLASS32 (1):32 位 ELF;ELFCLASS64 (2):64 位 ELF。

第 6 字节:

EI_DATA表示 字节序:ELFDATA2LSB (1):小端;ELFDATA2MSB (2):大端;- 0 为无效。

第 7 字节:

EI_VERSION表示 ELF 标准版本,目前固定为:EV_CURRENT (1):当前 ELF 规范版本,仅仅是一个版本号,并不是“1.2 版本”之类的概念。

第 8 字节:

EI_OSABI指示目标 OS/ABI,比如:ELFOSABI_SYSV(System V,最常见),- Linux、FreeBSD 等的专有值。

**第 9 字节:

EI_ABIVERSION**:OS/ABI 的版本号,大部分系统中为 0。第 10~15 字节:

EI_PAD及保留:用于填充和保留,一般填 0,部分平台可能用这几字节做扩展。

e_type:文件类型表示 ELF 文件的整体类型,常见取值(宏名以

ET_开头):ET_REL:可重定位文件(.o);ET_EXEC:可执行文件;ET_DYN:共享对象(.so),也包括 PIE 可执行文件;ET_CORE:core dump。

e_machine:目标体系结构表示目标架构 / 指令集,例如:

EM_386、EM_X86_64、EM_ARM、EM_AARCH64等。

不同架构在重定位类型、指令编码、对齐等方面都不相同,动态链接器、调试器等会根据这个字段选择对应的处理逻辑。

e_version:ELF 文件版本一般为:

EV_CURRENT (1)。它与

e_ident[EI_VERSION]一致,都是当前 ELF 版本号,一般不会是其它值。

e_entry:程序入口虚拟地址表示程序开始执行时的 入口虚拟地址:

对 可执行文件 / PIE / 共享对象:

- 指向程序或共享库的入口地址;

- 对可执行文件来说,内核或动态链接器最终会跳到这里,执行运行时初始化后再进入

main。

对 可重定位文件(

ET_REL):- 通常没有入口意义,一般为 0。

e_phoff:程序头表文件偏移表示 程序头表(Program Header Table)在文件中的偏移(字节):

- 对

ET_EXEC/ET_DYN/ET_CORE:通常非 0,内核 / 动态链接器加载时必须用到; - 对

ET_REL:一般为 0(不需要程序头表,但规范允许存在)。

若

e_phoff == 0,通常表示“本文件没有程序头表”。- 对

e_shoff:节头表文件偏移表示 节头表(Section Header Table)在文件中的偏移(字节):

- 链接器、调试器通过它来定位

.text、.data等各节的元信息; - 对某些被完全 strip 的可执行文件 / 共享库,

e_shoff可能为 0(没有节表),程序依然可以正常执行,只是调试 / 链接信息丢失。

- 链接器、调试器通过它来定位

e_flags:处理器特定标志这是一个与架构相关的标志字段:

- 对 x86 / x86‑64 等架构通常为 0;

- 对 ARM、MIPS 等架构,可能编码 ABI、指令集模式等信息。

其具体意义需要参考对应架构的 ABI 文档。

e_ehsize:ELF 头大小表示 ELF 文件头自身的大小(字节数):

- 对 32 位 ELF,一般为

sizeof(Elf32_Ehdr),典型值 52; - 对 64 位 ELF,一般为

sizeof(Elf64_Ehdr),典型值 64。

解析 ELF 时可以用该字段来校验读到的头部是否完整。

- 对 32 位 ELF,一般为

e_phentsize/e_phnum:程序头表项大小与数量e_phentsize:程序头表中 每个表项(Elf*_Phdr)的大小;e_phnum:程序头表中 表项数量。

当

e_phnum == 0时,表示本文件中没有程序头表(例如纯ET_REL文件或某些特殊构造)。

e_shentsize/e_shnum:节头表项大小与数量e_shentsize:节头表中 每个表项(Elf*_Shdr)的大小;e_shnum:节头表中 表项数量。

当

e_shnum == 0时,通常意味着文件中没有节表(例如被完全 strip 且不再需要调试 / 链接用途的二进制)。

e_shstrndx:节名字符串表索引e_shstrndx指明:在节头表中,哪一个节(按

Elf*_Shdr索引)是 节头字符串表(Section Header String Table,一般名为.shstrtab)。.shstrtab中保存了所有“节名”的字符串;- 每个

Elf*_Shdr::sh_name字段是相对于.shstrtab的偏移; - 若

e_shstrndx == SHN_UNDEF (0),通常表示没有节名字符串表(少见,多见于特殊或混淆过的 ELF)。

程序头表

在 ELF 中,有两套“描述结构”:

- 节表(Section Header Table):描述的是 节(Section),主要给链接器、调试器用。

- 程序头表(Program Header Table):描述的是 段(Segment),主要给操作系统装载器 / 动态链接器用。

一般来说:

- 可执行文件(

ET_EXEC):有程序头表; - 共享对象(

ET_DYN,共享库 / PIE):有程序头表; - 可重定位目标文件(

ET_REL):通常没有程序头表,只需要节表即可(也可以有,但实际工具链基本不会这么干)。

程序头表描述的是装载相关的“段”,而目标文件不直接被操作系统装载执行,所以通常不需要程序头表。

程序头表是一个由 Elf*_Phdr 结构体构成的数组,每个 Phdr 描述一个 段(Segment),而不是“每个节”。

段是面向“内存装载”的视图:

OS 根据程序头表决定:- 从文件的哪个偏移 (

p_offset) 读多少字节 (p_filesz) - 把它们映射到内存中的哪个虚拟地址 (

p_vaddr),映射多大 (p_memsz) - 映射的权限(读 / 写 / 执行:

p_flags)

- 从文件的哪个偏移 (

一个段可以覆盖多个节;多个属性相同的节会被合并进同一个

PT_LOAD段里。

以 32 位为例(64 位只是字段宽度不同)Elf32_Phdr 结构如下:

1 | /* Program segment header. */ |

各字段含义:

p_type:段类型指定该条目表示什么类型的段,常见值(省略很多):

PT_NULL:无效条目,忽略;PT_LOAD:可装载段,真正会映射到进程虚拟地址空间(代码 / 数据等都在这里);PT_DYNAMIC:动态链接信息所在的段,对应.dynamic;PT_INTERP:解释器(通常是动态链接器)路径所在段,对应.interp;PT_NOTE:NOTE信息;PT_GNU_STACK等:GNU 扩展,用于指定栈是否可执行。

“可执行段、数据段”这类说法其实是由

PT_LOAD+p_flags(读写执行)组合出来的,而不是p_type本身区分“代码段 / 数据段”。p_offset:文件偏移段在 文件中的起始偏移(字节)。装载器从这个位置开始读数据。

p_vaddr:虚拟地址段在 进程虚拟地址空间中的起始地址。

对于PT_LOAD段,必须是页对齐的,且会参与实际的内存映射。

对于某些非装载段(如PT_NOTE),这个字段的解释依 ABI 而定,可能为 0 或未使用。p_paddr:物理地址段在物理内存中的地址。

- 在大多数通用操作系统(Linux 等)中,进程只关心虚拟地址,这个字段通常被忽略或与

p_vaddr保持一致,更多是给某些裸机 / 特殊系统预留的。 - 所以简单记:在普通用户空间程序里,可以当作保留字段看待。

- 在大多数通用操作系统(Linux 等)中,进程只关心虚拟地址,这个字段通常被忽略或与

p_filesz:文件中大小段在文件中占据的字节数。

p_memsz:内存中大小段映射到内存时占据的字节数。

常见关系:

p_memsz >= p_filesz- 对于

.bss这种“未初始化数据”,相应部分不会写入文件,只在内存中以 0 填充; - 这时

p_filesz小于p_memsz,多出来的部分由内核(或运行时)做清零。

- 对于

p_flags:段标志常用为位组合:

PF_X:可执行PF_W:可写PF_R:可读

OS 会据此设置内存页的权限。

p_align:对齐要求段在文件和内存中的对齐约束:

若

p_align > 1,则通常需要满足:p_vaddr % p_align == p_offset % p_align

对于

PT_LOAD段,p_align一般是 页大小(如 0x1000),确保段起始地址为页对齐。若

p_align为 0 或 1,表示没有特殊对齐要求。

节表

ELF 文件中使用一组 Elf*_Shdr 结构体来描述每一个节,这些结构体顺序排在一起,构成 节表(Section Header Table):

- 每个表项大小固定(

e_shentsize),类型为Elf32_Shdr或Elf64_Shdr; - 表项个数由 ELF 头里的

e_shnum指定; - 整个节表在文件中的位置由

e_shoff给出。

段(Segment) vs 节(Section)

节(Section)

是文件级的逻辑组织单位,用来按“用途”划分内容:

- 代码:

.text- 已初始化数据:

.data- 未初始化数据:

.bss(SHT_NOBITS)- 只读数据:

.rodata- 符号表:

.symtab- 字符串表:

.strtab/.dynstr- ……

每个节在节表里对应一个

Elf*_Shdr表项,给出它在文件中的偏移、大小、属性等。链接器 / 调试器主要看“节”。

段(Segment)

- 是内存装载视图,由 Program Header(

Elf*_Phdr,类型PT_LOAD/PT_DYNAMIC/PT_INTERP等)描述;- 一个段通常对应进程虚拟地址空间中的一个连续区间(比如“这块内存可读+可执行,用来放代码”和“这块内存可读+可写,用来放数据”);

- 一个 PT_LOAD 段内部可以包含多个 section(例如

.text+.rodata合在一个只读+可执行段里)。- 操作系统装载器只看“段”(Program Header),可以完全不理会节表。

链接器会把属性相同的节(比如都只读+可执行的

.text/.rodata)打包到同一个PT_LOAD段中;装载时,内核只根据“段”来把文件映射进内存,而不关心“节”的细节。

ELF 使用一个由 Elf*_Shdr 组成的数组来描述所有 节(section),每个表项大小固定,但数组长度(节个数)不固定,由 ELF 头决定。

以 32 位为例(64 位只是字段宽度不同)

Elf32_Shdr结构如下:1

2

3

4

5

6

7

8

9

10

11

12

13

14

15/* Section header. */

typedef struct

{

Elf32_Word sh_name; /* Section name (string tbl index) */

Elf32_Word sh_type; /* Section type */

Elf32_Word sh_flags; /* Section flags */

Elf32_Addr sh_addr; /* Section virtual addr at execution */

Elf32_Off sh_offset; /* Section file offset */

Elf32_Word sh_size; /* Section size in bytes */

Elf32_Word sh_link; /* Link to another section */

Elf32_Word sh_info; /* Additional section information */

Elf32_Word sh_addralign; /* Section alignment */

Elf32_Word sh_entsize; /* Entry size if section holds table */

} Elf32_Shdr;各字段含义:

sh_name:节名索引- 表示节名在“节名字符串表”(

.shstrtab)中的索引。 .shstrtab是一个专门用来存放“节名字符串”的节,它本身在节头表中的索引由 ELF 头的e_shstrndx给出。- 因此

sh_name指向的是.shstrtab,不是.strtab/.dynstr这些普通字符串表。

- 表示节名在“节名字符串表”(

sh_type:节类型描述该节的类型,从而决定这节的用途和解释方式。

常见取值(只列常用的):

SHT_NULL (0):无效节(占位用)。SHT_PROGBITS (1):程序自定义内容(代码、常量等),例如.text、.rodata、.data通常都是这个类型。SHT_SYMTAB (2):静态符号表,例如.symtab。SHT_STRTAB (3):字符串表,例如.strtab、.dynstr、.shstrtab。SHT_RELA (4)/SHT_REL (9):重定位表(分别为带 / 不带显式 addend 的形式)。SHT_NOBITS (8):不在文件中占空间的节,例如.bss。- ……

注意:**“代码段 / 数据段”是节的用途,不是不同的

sh_type**,代码和数据一般都属于SHT_PROGBITS。

sh_flags:节标志描述该节在内存中的属性,常见标志:

SHF_WRITE:节在内存中可写。SHF_ALLOC:装载时会被映射到进程地址空间。SHF_EXECINSTR:节中包含可执行指令。- ……

链接器 / 装载器会据此决定该节应放入什么样的

PT_LOAD段,以及映射时的页权限(r/w/x)。

sh_addr:虚拟地址- 表示该节在内存中的虚拟地址。

- 对 可重定位文件(

ET_REL):一般为 0(尚未分配最终虚拟地址)。 - 对 可执行文件(

ET_EXEC)和共享对象(ET_DYN) 中带SHF_ALLOC的节:该字段表示此节在进程地址空间中的位置(通常是相对装载基址的偏移)。 - 总结:只对带

SHF_ALLOC的节、且在已定址的 ELF(ET_EXEC/ET_DYN)中有实际意义。

sh_offset:文件偏移表示该节在 ELF 文件中的起始偏移(字节)。

对绝大多数节,这就是节内容在文件里的位置。

对

SHT_NOBITS(例如.bss):- 按规范

sh_offset仍然有定义——表示“如果这节在文件中有数据,应该放在这里”; - 但这种节在文件中不占空间,loader 只会根据

sh_type == SHT_NOBITS和sh_size在内存中划出一块区域并清零,而不会从文件这个位置读取。

- 按规范

sh_size:节大小- 表示该节的大小(字节数)。

- 对

SHT_NOBITS:表示这块在内存中需要保留的大小(虽然文件中没有对应数据)。

sh_link:链接信息含义依

sh_type不同而不同,一般用来“指向另一个相关的节”:- 对

SHT_SYMTAB/SHT_DYNSYM:sh_link通常是该符号表所使用的字符串表(.strtab/.dynstr)在节头表中的索引。 - 对重定位节(

SHT_REL/SHT_RELA):sh_link通常是所引用的符号表节的索引。 - 其它类型也有各自约定。

- 对

简单理解:“关联到哪个节”,具体要看节类型的说明。

sh_info:附加信息同样是与

sh_type相关的附加字段:- 对

SHT_SYMTAB/SHT_DYNSYM:通常表示本地符号个数(STB_LOCAL的符号数量)。 - 对重定位节:通常表示“本节要重定位的目标节”的索引。

- 其它类型用法依 ABI 约定。

- 对

可以简单记为:“额外信息字段,其含义随节类型而变”。

sh_addralign:地址对齐约束描述该节在内存中的对齐要求:

若

sh_addralign == 0或sh_addralign == 1:表示没有特别的对齐要求,可认为是字节对齐。否则

sh_addralign一般是 2 的幂,并要求:1

sh_addr % sh_addralign == 0

sh_entsize:表项大小若该节存放的是由定长表项组成的表(例如符号表、重定位表),则

sh_entsize表示每个表项的大小(字节数):- 对

.symtab/.dynsym:通常是sizeof(Elf32_Sym)/sizeof(Elf64_Sym)。 - 对

.rel.*/.rela.*:通常是sizeof(Elf32_Rel)/Elf32_Rela等。

- 对

若

sh_entsize == 0:表示该节不是“定长表项数组”,例如.text、.rodata这类普通数据区域。

ELF 中常见的节如下:

.text

代码节,存放程序的机器指令,通常SHT_PROGBITS+SHF_ALLOC | SHF_EXECINSTR。.rodata

只读数据节,存放字符串常量、常量表等,通常SHT_PROGBITS+SHF_ALLOC(不带SHF_WRITE)。.data

已初始化的可写全局 / 静态变量,通常SHT_PROGBITS+SHF_ALLOC | SHF_WRITE。.bss

未初始化的全局 / 静态变量,SHT_NOBITS,带SHF_ALLOC | SHF_WRITE:- 在文件中不占实际数据空间(只有节头),

- 装载时在内存中分配

sh_size字节并清零。

.symtab

静态符号表,SHT_SYMTAB,供链接器 / 调试器使用,可能在 strip 后被移除。.strtab

字符串表,SHT_STRTAB,配合.symtab存符号名等字符串。.rel.text/.rela.text

代码重定位信息,分别是SHT_REL/SHT_RELA类型,链接时用来修正.text内的地址引用。.rel.data/.rela.data

数据重定位信息,用于修正.data等数据节中的地址引用。.dynamic

动态节,SHT_DYNAMIC,内部是Elf*_Dyn数组,描述动态链接所需的信息:- 动态符号表、字符串表、重定位表的位置和大小;

- 依赖的共享库名(

DT_NEEDED)所在的字符串表索引; - 初始化/终止函数地址等。

本身不是重定位表或符号表,而是这些表的“目录”。

.note.*

注释 / 说明 / 元数据节,SHT_NOTE:- 常见如

.note.ABI-tag、.note.gnu.build-id,存放 ABI 信息、build-id 等; - 不等同于 DWARF 调试节(那些通常是

.debug_*)。

- 常见如

字符串表

在 ELF 文件里会出现大量字符串,例如:

- 段名(section name)

- 符号名(函数名、变量名)

- 动态链接相关的各种名字

由于字符串长度不定,如果在每个需要名字的结构里都直接放一个“定长字符串字段”,会非常浪费空间,也不灵活。

ELF 的做法是:把所有字符串集中放到一个“字符串表”(String Table)里,然后在各个结构中用“偏移量”来引用字符串。

字符串表本质上就是一段连续的字节数组。

某个字段(比如

sh_name、st_name)存的不是字符串本身,而是:从该字符串表起始处到目标字符串开头的 字节偏移(index / offset)。

这样,ELF 内部引用字符串时只要给出一个整数偏移即可,不需要关心字符串实际长度。

在 ELF 中,字符串表以 节(section) 的形式出现,节类型为 SHT_STRTAB。常见的名字有:

.shstrtab—— Section Header String Table- “段表字符串表”:专门存放 段表(section header table)用到的字符串。

- 最典型的就是段名,供

ElfXX_Shdr::sh_name字段引用。

.strtab—— String Table- 一般用作 普通符号表

.symtab的名字字符串表,保存各种符号名(函数名、全局变量名等)。

- 一般用作 普通符号表

.dynstr—— Dynamic String Table- 供

.dynsym(动态符号表)、.dynamic等动态链接相关结构使用,保存运行时需要的那些字符串。

- 供

说明:在简单的介绍里,常会只提

.strtab和.shstrtab两个表来讲概念,这没有问题。但真实 ELF 里还经常能看到.dynstr这样的动态字符串表。

常见的“通过偏移引用字符串”的例子有:

段表条目中的

sh_name字段类型:

uint32_t含义:这是相对于

.shstrtab开头的字节偏移。动态装载器/分析工具会:

- 找到段表字符串表

.shstrtab - 从偏移

sh_name开始,读取一个以'\0'结尾的字符串,这就是该 section 的名字。

- 找到段表字符串表

符号表条目中的

st_name字段(.symtab/.dynsym)- 类型:

uint32_t - 含义:这是相对于对应字符串表 (

.strtab或.dynstr) 开头的字节偏移。 - 通过这个偏移就能拿到符号名。

- 类型:

你可以把字符串表理解成一个字符串池,而 sh_name / st_name 这些字段就是“指向池里面某个字符串的偏移指针”。

ELF 字符串表中的字符串是以 \x00 结尾的 C 风格字符串,字符串之间紧挨着存放。

关键点:

每个字符串是:

- 若干个非零字节

- 后面跟一个

'\0'(即\x00)作为结尾

整个字符串表的第 0 个字节 被规定为

'\0':- 这就构成了一个“空字符串”,偏移为 0。

- 当某些字段(比如

sh_name或st_name)为 0 时,就表示“没有名字”或“名字为空”。

相邻字符串之间 只需要结尾处的那个

\x00来做分隔,不会在“每个字符串的开头再填一个\x00”。

调用约定

栈结构

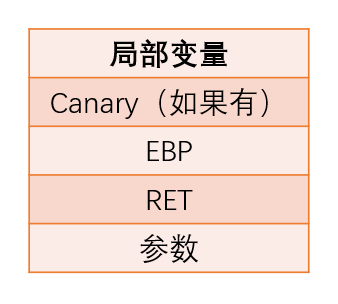

注意

canary 不一定与 ebp 相邻,因为有些函数会先将一些寄存器保存到栈中。canary 实际位置以调试为准。

函数调用过程

32位为例:

函数参数传递

注意:通常 linux 下的程序的函数调用都是外平栈的。

32 位程序

普通函数

Linux 使用 cdecl 调用约定,所有参数 从右到左 压入栈中。由 调用者(caller) 负责清理栈上的参数。使用 EAX 返回函数值。

系统调用

在 32 位 Linux(x86 架构)中,用户态通过 int 0x80 进入内核执行系统调用。为了提高兼容性,Linux 系统主要采用 int 0x80,而不是 sysenter,因为后者需要硬件支持和额外的返回跳板机制。

系统调用时,调用号和参数都通过寄存器传递,具体分配如下:

EAX寄存器用于存放系统调用号(syscall number)。EBX、ECX、EDX、ESI、EDI、EBP依次用于传递系统调用的第 1 到第 6 个参数。

系统调用返回时,结果会存放在 EAX 中。如果调用成功,EAX 中为返回值;如果失败,则 EAX 为负值(对应负的 errno 编号)。

64位程序

普通函数

在 64 位 Linux(x86_64 架构)中,普通函数调用遵循 System V AMD64 ABI 调用约定,这是当前 Linux 平台上 C/C++ 等语言的标准调用方式。

函数参数通过寄存器优先传递,具体为:

RDI、RSI、RDX、RCX、R8、R9依次用于传递前 6 个参数。- 超过 6 个参数的部分,从右到左压入栈中。

函数返回值通过 RAX 返回,若返回值过大或为结构体,可能使用多个寄存器(必要时用 RDX:RAX 返回 128bit)或通过内存返回。

在寄存器使用上,调用者负责保存 RAX、RCX、RDX、RDI、RSI、R8~R11 等 caller-saved 寄存器;而 RBX、RBP、R12~R15 等 callee-saved 寄存器由被调用函数保存。

函数调用前,要求栈地址必须对齐到 16 字节,否则在使用某些 SSE 指令时会触发崩溃。

系统调用

在 64 位 Linux(x86_64 架构)中,用户态通过 syscall 指令进入内核执行系统调用。相比 32 位的 int 0x80,syscall 是专为 64 位架构设计的系统调用指令,执行效率更高,也是当前主流的调用方式。

系统调用时,调用号和参数都通过寄存器传递,具体分配如下:

RAX寄存器用于存放系统调用号(syscall number)。RDI、RSI、RDX、R10、R8、R9依次用于传递系统调用的第 1 到第 6 个参数。

注意

第 4 个参数使用 R10 而不是 RCX,因为 RCX 在执行 syscall 时会被硬件破坏(用作返回地址保存)。

系统调用返回时,结果会存放在 RAX 中。如果调用成功,RAX 中为返回值;如果失败,则 RAX 为负值(对应负的 errno 编号)。

系统调用号

32 位

1 |

64 位

1 |

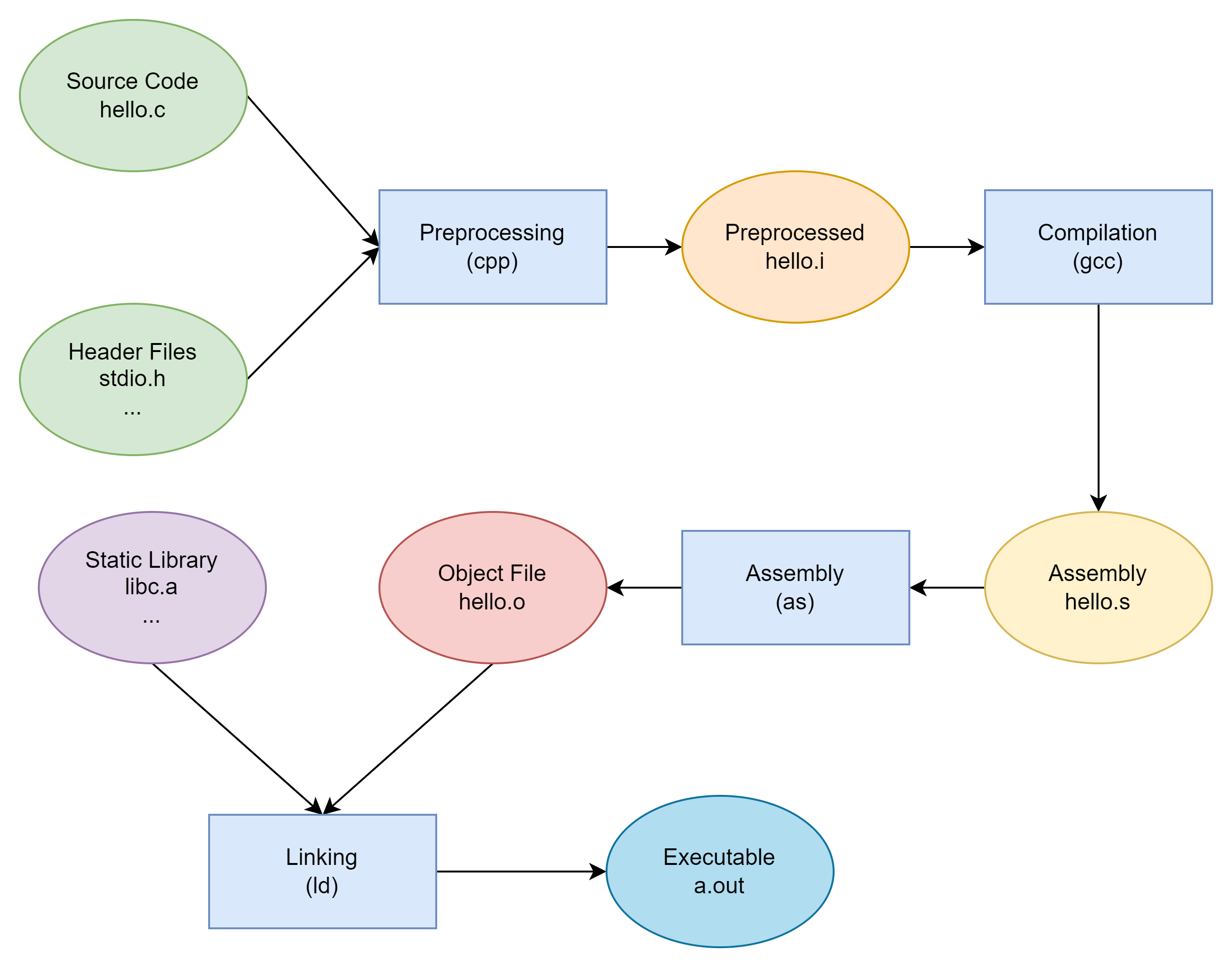

程序编译过程

从源码到最终 ELF 可执行文件(或共享库),通常会经历几个主要阶段:

源代码(

.c/.cpp)

➜ 预处理(生成.i/.ii)

➜ 编译(生成汇编.s)

➜ 汇编(生成目标文件.o)

➜ 链接(生成 ELF 可执行文件 / 共享库)

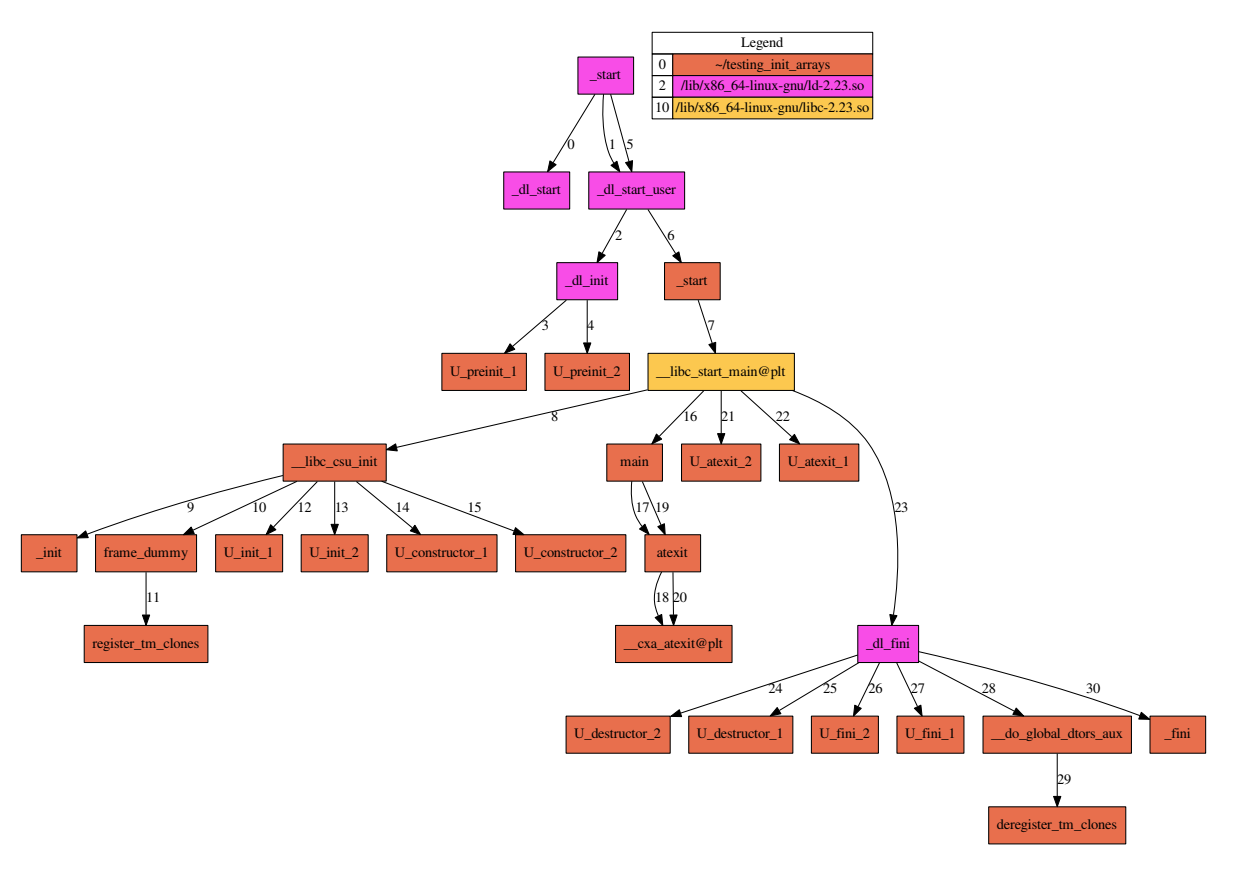

从源文件编译链接形成 ELF 文件的过程如下图所示:

预处理(Preprocessing)

预处理阶段由预处理器(通常是 GCC 内部的 cpp 前端)完成,把源文件和头文件“拼装 + 展开”成一个纯文本的中间文件:

C 源文件:

- 源文件扩展名:

.c - 预处理后扩展名:

.i

- 源文件扩展名:

C++ 源文件:

- 源文件扩展名:

.cpp/.cxx等 - 预处理后扩展名:

.ii

- 源文件扩展名:

典型命令(-E 表示“只做预处理,不继续编译”):

1 | gcc -E hello.c -o hello.i |

或者直接调用预处理器:

1 | cpp hello.c > hello.i |

预处理阶段主要处理所有以 # 开头的预处理指令,常见规则包括:

展开和移除宏定义

- 展开所有通过

#define定义的宏; - 源文件里的

#define本身不会出现在.i中(系统头里的一些实现细节可能因选项不同略有差异)。

- 展开所有通过

处理条件编译指令

- 如

#if/#ifdef/#elif/#else/#endif; - 根据条件选择性地保留或丢弃代码块。

- 如

展开

#include- 将被包含的头文件内容“内联”到当前文件中;

- 这个过程是递归的:包含的文件里还可以继续

#include其他文件。

删除注释

- 删除所有

//和/* ... */注释(变成纯代码文本)。

- 删除所有

插入行号和文件名标记

生成类似下面这样的行标记:

1

# 2 "hello.c" 2

这些用于:

- 编译器在报错/告警时能正确显示“原始源文件 + 行号”;

- 生成调试信息时记录源码位置。

保留必要的

#pragma#pragma指令通常会被保留下来,由后续编译阶段处理。

预处理之后得到的 .i / .ii 文件本质上还是 C/C++ 源代码,只是:

- 所有宏都已经展开;

- 所有

#include的头文件都已经展开进来; - 不再包含一般的预处理指令(除了行标记和部分

#pragma)。

编译(Compilation)

编译阶段的任务是:把预处理后的源代码翻译成目标机器的汇编代码。

编译器在这一阶段会进行:

- 词法分析(Lexical Analysis):把字符流切分成 token;

- 语法分析(Parsing):检查语法是否合法,构建语法树;

- 语义分析(Semantic Analysis):类型检查、作用域解析、常量折叠等;

- 中间表示(IR)生成与优化:如常量传播、死代码删除、循环优化等;

- 目标相关优化:指令选择、寄存器分配等;

- 输出汇编代码(

.s文件)。

常见命令示例(从预处理后的 .i 出发):

1 | gcc -S hello.i -o hello.s |

一般更常用的是直接从 .c 开始,让 GCC 自动完成“预处理 + 编译”两步:

1 | gcc -S hello.c -o hello.s |

此时生成的 hello.s 是与平台/架构相关的 汇编代码。

汇编(Assembly)

汇编阶段由汇编器(如 GNU as,但通常通过 gcc 间接调用)完成,把 .s 汇编代码翻译成机器码,生成 目标文件(Object File,.o)。

每条汇编指令大多对应一条机器指令(也会有伪指令、宏指令等间接映射的情况);

相比编译器,汇编器的工作相对简单:

- 不再做高级语言的语法/语义分析;

- 主要负责解析汇编伪指令、符号、重定位信息、节布局等;

- 将其组织成符合目标平台 ABI 的 ELF 目标文件。

可以直接调用汇编器:

1 | as hello.s -o hello.o |

更常见的是用 gcc 一步从 C 源码生成 .o,让它在内部自动完成“预处理 + 编译 + 汇编”:

1 | gcc -c hello.c -o hello.o |

-c 的含义是:只生成目标文件,不进行链接。

得到的 hello.o 一般是 ELF 格式的 ET_REL 文件,包含:

- 机器指令和数据;

- 符号表、重定位表等链接所需的信息。

链接(Linking)

“编译过程中的链接阶段” = 由 ld 完成的,把一堆 .o 和库文件合成一个 ELF 的那一步,它是所有程序(无论静态还是动态链接)都会经历的统一阶段。

这一阶段对应如下命令:

1 | gcc main.o foo.o -o prog # gcc 在背后帮你调用 ld |

输入:

一个或多个 目标文件:

main.o、foo.o…

内部是 ELF

ET_REL,包含:

- 各种节:

.text、.data、.bss等- 符号表

.symtab/ 字符串表.strtab- 重定位表

.rel.text、.rel.data/.rela.*若干 库文件:

静态库:

libxxx.a

- 其实是很多

.o的打包(ar 格式),链接器会按需从里面挑成员出来用共享库:

libxxx.so

- ELF

ET_DYN文件启动文件 / 运行时:

crt1.o、crti.o、crtn.o等 C 运行库的启动代码libgcc.a等编译器运行时支持库输出:

- 可执行文件:

prog

- 传统非 PIE:

ET_EXEC- PIE:

ET_DYN,但带入口、可直接运行- 或者 共享库:

libxxx.so(ELFET_DYN)

静态 / 动态程序的区别,只在于链接器把多少工作留到运行时去做。

站在“编译期链接器”的角度:

静态链接程序(

-static)

- 把用到的静态库

.a中的函数 / 变量实现代码都拷贝进最终可执行文件;- 尽量在链接阶段把所有符号地址定死;

- 最终 ELF 通常没有

PT_INTERP,运行时不需要动态链接器参与;- GOT/PLT 也可以存在,但只在程序内部跳,不依赖外部

.so。动态链接程序(默认)

自己的

.o+ 启动文件依然正常合并、重定位;对共享库

.so:

- 不复制代码,只登记依赖(

DT_NEEDED);- 建好

.dynsym/.dynstr/.rela.*/.plt/.got等结构;- 留下一部分重定位条目由动态链接器在运行时处理。

最终 ELF 一定有

PT_INTERP(指定动态链接器)。所以,编译阶段的“链接”总是存在,无论你生成的是静态程序还是动态程序,只是:

- 静态程序:绝大部分链接工作在这一阶段一次性完成;

- 动态程序:这一阶段先完成一部分,剩下交给运行时的动态链接器继续做。

ELF 相关结构

在 可重定位目标文件(ET_REL,即 .o) 中,链接器主要依赖以下信息完成“静态链接”:

符号表:

.symtab(SHT_SYMTAB,元素类型Elf*_Sym)字符串表:

.strtab(存放符号名等)重定位表:

- 代码相关:

.rel.text/.rela.text - 数据相关:

.rel.data/.rela.data

- 代码相关:

以及各种属性节(

.text/.data/.bss等)

静态链接时使用的重定位节(.rel.text / .rela.text、.rel.data / .rela.data 等)只存在于 ET_REL 这样的中间目标文件中。

当链接器把多个 .o 合成最终的 可执行文件(ET_EXEC) 或 共享对象 / PIE(ET_DYN) 时,会:

读取这些重定位条目;

把对应位置的指令 / 数据修正好;

通常会把这些“静态重定位节”删掉,所以在最终 ELF 里一般看不到

.rel.text/.rel.data之类。当链接器把一堆

.o链起来之后,静态链接这轮其实已经结束了,从链接器的角度:- 符号都已经解析好了;

- 该重定位的都打好补丁了;

- 那么理论上,“给静态链接用的那些

.symtab/.strtab/.rel.*也可以不用保留了”。

所以从 纯“执行程序”角度 看:

- **运行时不需要

.symtab/.strtab**(动态链接用的是.dynsym/.dynstr,那是另一套); - 也不需要

.rel.text/.rel.data(静态链接用完就扔了); - 留它们只是方便人类和工具(调试、反汇编、分析等)。

关键点:链接器的默认行为是“生成未 strip 的二进制”——方便你:

- 用

gdb调试; - 用

nm/objdump看符号名; - 在崩溃 backtrace 中能打印出函数名,而不仅是地址。

而且注意:

.symtab就算没有-g,通常也会存在(只是符号信息没那么丰富);-g控制的是生成.debug_*等 DWARF 调试信息节(.debug_info、.debug_line、.debug_abbrev等),而不直接控制.symtab是否出现。

换句话说:

.symtab/.strtab= 符号表 + 名字表,链接器必用,在最终 ELF 里保留与否是“方便人”的选择;-g= “生成详细调试信息(DWARF)”,主要体现在.debug_*这些节上。

真正控制

.symtab/.strtab要不要留的,是strip或链接器选项,比如:strip prog/strip --strip-all prog- 会干掉大部分符号信息(包括

.symtab、.strtab、.debug_*等);

- 会干掉大部分符号信息(包括

strip --strip-debug prog- 只删调试节

.debug_*,通常会保留必要的符号(比如.dynsym),具体行为看实现;

- 只删调试节

链接时用

-Wl,--strip-all/-s:- 直接让 ld 在生成时就去掉符号。

这就是为什么:

- 你看到有些 pwn 题附件有函数名、有

.symtab(没 strip 或只 strip 了调试信息); - 有些则啥名都没了,只剩下

.dynsym或极少量符号(被 strip 过)。

与之对应,最终的可执行文件 / 共享对象里还会保留一套“动态重定位信息”(例如 .rela.dyn、.rela.plt),是给 动态链接器在运行时 用的,主要用于:

- 根据实际装载地址(ASLR / PIE)修正 GOT、静态指针等(

R_*_RELATIVE); - 修正导入函数 / 变量(

R_*_JUMP_SLOT、R_*_GLOB_DAT等)。

符号表(.symtab)

在 ELF 文件中,静态符号表通常是一个名为 .symtab 的节:

- 节类型:

SHT_SYMTAB - 元素类型:

Elf32_Sym/Elf64_Sym数组

以 32 位为例:

1 | /* Symbol table entry. */ |

各字段含义:

st_name:符号名索引- 指向某个 字符串表节(通常是

.strtab)中的偏移; - 字符串表的节索引(section index)由符号表节头的

sh_link指定。

- 指向某个 字符串表节(通常是

st_value:符号值在 可重定位文件(

ET_REL) 中:如果符号是定义在某个节里的(且

st_shndx不是特殊值,例如既不是SHN_UNDEF也不是SHN_COMMON),

则st_value表示 相对于该节起始地址的偏移;如果

st_shndx == SHN_COMMON(所谓“COMMON 块”/暂定定义),

则:st_value表示该符号所需的 对齐;st_size表示所需空间大小。

链接器最终会把这些符号分配到

.bss等处。

在 可执行文件 / 共享对象(

ET_EXEC/ET_DYN) 中:- 对带

STB_GLOBAL/STB_WEAK等可见性符号,st_value一般表示符号的 虚拟地址(或相对装载基址的偏移)。

- 对带

st_size:符号大小- 对函数符号:通常是函数机器码的长度;

- 对对象符号:是该对象占用的字节数;

- 若为 0:表示大小为 0 或未知(链接器 / 调试器会根据实际上下文处理)。

st_info:类型 + 绑定这是一个打包字段:

- 高 4 位:绑定(binding),

STB_LOCAL/STB_GLOBAL/STB_WEAK等; - 低 4 位:类型(type),

STT_NOTYPE/STT_OBJECT/STT_FUNC/STT_SECTION等。

- 高 4 位:绑定(binding),

取值一般通过宏:

ELF32_ST_BIND(st_info)得到绑定;ELF32_ST_TYPE(st_info)得到类型;ELF32_ST_INFO(bind, type)组装。

st_other:可见性等信息- 低 2 位通常表示 符号可见性:

STV_DEFAULT/STV_HIDDEN/STV_PROTECTED等; - 其它位保留,一般为 0。

- 低 2 位通常表示 符号可见性:

st_shndx:所在节索引 / 特殊标记一般情况:

st_shndx为某个有效节号,表示符号定义于该节;

特殊情况(部分):

SHN_UNDEF:未定义符号(当前文件中只引用、未定义),需要在链接时从其他目标文件 / 库中解析。SHN_ABS:绝对符号,其值不随重定位变化(如某些常量)。SHN_COMMON:COMMON 符号(见上:st_value表示对齐,st_size为空间大小)。

重定位表(.rel.* / .rela.*)

在 静态链接阶段,链接器通过重定位表知道“哪些位置需要根据符号的最终地址进行修正”。

常见的“静态重定位节”有:

.rel.text/.rela.text:对.text代码节中的重定位;.rel.data/.rela.data:对.data等数据节中的重定位。

.rel.*和.rela.*都是“重定位节”,区别在于:**.rel.*用的是Elf*_Rel,没有显式 addend;**

.rel.*:节类型是 **SHT_REL**,元素结构是Elf32_Rel/Elf64_Rel:

2

3

4

Elf32_Addr r_offset; /* Address */

Elf32_Word r_info; /* Relocation type and symbol index */

} Elf32_Rel;没有

r_addend字段。

.rela.*:节类型是 **SHT_RELA**,元素结构是Elf32_Rela/Elf64_Rela:

2

3

4

5

Elf32_Addr r_offset; /* Address */

Elf32_Word r_info; /* Relocation type and symbol index */

Elf32_Sword r_addend; /* Addend */

} Elf32_Rela;多了一个

r_addend字段。节名的约定通常是:

- 用

SHT_REL的节叫.rel.xxx- 用

SHT_RELA的节叫.rela.xxx名字本身没有魔法,只是惯例;真正的区别在

sh_type和表项结构体。所有 ELF 重定位的计算本质都是类似:

新值 = 符号值

S+ addendA(再根据重定位类型决定是不是还要加P等)区别只在于 addend

A从哪儿来:

Elf*_Rel里没有r_addend字段;addend 存在被重定位的位置本身:

对

ET_REL:编译器/汇编器在生成.o时,把一个“初始值”写到r_offset对应的位置;链接器 / 动态链接器在做重定位时:

- 先读出当前位置原来的内容,作为 addend

A;- 用

S、A、重定位类型算出新值;- 再把新值写回这个位置。

可以理解为:“addend 嵌在代码/数据里”。

Elf*_Rela里有显式的r_addend;**addend 不再从内存中读,而是直接用表项里的r_addend**:

- 计算时直接用

A = r_addend,然后根据类型算出新值写到r_offset位置;- 重定位前,

r_offset对应地址里的内容对计算不重要(往往是 0)。可以理解为:“addend 单独存在重定位表里”。

以 32 位 REL 为例(不带 addend):

1 | /* Relocation table entry without addend (in section of type SHT_REL). */ |

各字段含义:

r_offset:待修正位置对于 可重定位文件(

ET_REL):r_offset表示“需要重定位的位置相对于所属节起始的偏移”;- 哪个节要被重定位,是通过重定位节头的

sh_info字段指向的。

对于最终的 可执行文件 / 共享对象中的动态重定位表(如

.rela.dyn/.rela.plt):r_offset一般是“待修正位置的虚拟地址”或者装载基址上的偏移;这时是动态链接器在运行时根据它进行修正。

r_info:符号索引 + 重定位类型这是一个打包字段,包含:

- 符号索引(指向某个符号表条目,一般是

.symtab/.dynsym); - 重定位类型(

R_*);

- 符号索引(指向某个符号表条目,一般是

在 32 位 System V ABI 下,通常约定:

低若干位为重定位类型;

高若干位为符号索引;

glibc 提供宏:

ELF32_R_SYM(r_info):取符号索引;ELF32_R_TYPE(r_info):取重定位类型;ELF32_R_INFO(sym, type):组合。

对

RELA形式(Elf32_Rela/Elf64_Rela)还会多一个r_addend字段,表示显式的加数,用法与具体重定位类型相关。

链接过程

收集 & 合并节

每个

.o里都有自己的.text/.data/.rodata/.bss等节;链接器根据链接脚本(默认或自定义)的规则,把多个目标文件里的同类节合并在一起,例如:

- 所有

.text→ 合成一个大的.text; - 所有

.data→ 合成一个大的.data; - 所有

.bss→ 合成一个大的.bss;

- 所有

同时决定它们在最终 ELF 中的文件布局顺序、对齐方式等。

符号解析(Symbol Resolution)

核心问题就是一句话:

“这个符号到底是哪个

.o/ 库里定义的?它对应哪一段代码或哪个变量?”

链接器会:

扫描所有

.o和库文件,读取它们的.symtab/.strtab:- 找到每个“符号名 → 定义位置”的对应关系;

- 本地符号(

STB_LOCAL)只在各自目标文件内部使用,不参与全局解析; - 全局 / 弱符号(

STB_GLOBAL/STB_WEAK)参与跨文件可见的解析。

处理未定义符号(

st_shndx == SHN_UNDEF):- 在当前

.o里只被引用,没有定义; - 链接器会在其它

.o或库中寻找相应的定义; - 找不到就报“未定义引用”。

- 在当前

对 静态库

.a的特殊处理:.a是很多.o的集合,链接器不会一次性把所有成员都拉进来;- 只有当某个未定义符号需要时,才按需从

.a中挑出某个.o加入链接; - 没有被用到的成员

.o不会被加入最终文件。

冲突检查:

- 同名全局符号在多个文件中均为强符号定义:报多重定义错误;

- 弱符号(

STB_WEAK)与强符号之间有一套优先级规则:通常是“强覆盖弱”。

这一步的结果是:

对于每一个“需要被引用的符号”,链接器都知道它:

- 在最终合并后的哪个节里;

- 偏移多少;

- 大小是多少。

地址分配 & 静态重定位(Relocation)

在有了“全局布局 + 符号解析结果”之后,链接器开始做“修地址”的工作。

地址分配(Assign Addresses) :为合并后的

.text/.data/.bss等分配文件偏移和虚拟地址区间;对

ET_EXEC类型的可执行文件:一般以某个固定基址为起点(例如 0x400000 + offset)PIE 与否是由 ELF 类型(

ET_EXECvsET_DYN)和代码生成方式决定的,理论上和“静态/动态链接”是正交的概念;但在目前主流 Linux 工具链中,**静态链接的可执行文件通常仍然生成为非 PIE 的

ET_EXEC**,即使指定了-fPIE -pie,实际也未必会得到真正的静态 PIE。因此,在分析实际二进制时,应以

readelf -h/checksec检查 ELF 类型和装载基址为准,而不是只看编译命令行参数。对

ET_DYN(包括共享库和 PIE):通常以 0 作为逻辑基址,真实装载时由内核 / 动态链接器整体平移,利于地址无关代码。

静态重定位(消耗

.rel.*/.rela.*) :在ET_REL的目标文件 中,每个要被重定位的节(比如.text/.data)通常有对应的重定位节:.rel.text/.rela.text:代码重定位;.rel.data/.rela.data:数据重定位。

其元素是

Elf*_Rel或Elf*_Rela,每一项包含:r_offset:当前目标文件中需要修正的位置;r_info:打包的“符号索引 + 重定位类型”;(RELA 情况下)

r_addend:显式 addend。

链接器做的事:

根据重定位节头的

sh_info找到“要被修正的是哪个节”(比如.text);通过

r_offset+ 该节在最终 ELF 中的起始地址,算出真正要 patch 的位置;用

r_info取出:- 需要引用的符号(从

.symtab找到对应Elf*_Sym); - 重定位类型(如

R_386_32/R_386_PC32等);

- 需要引用的符号(从

从符号表条目的

st_value(结合最终地址分配)得到符号在最终 ELF 中的地址或偏移;按照重定位类型的规则计算最终写回值,patch 到对应位置。

示例(32 位 x86 常见类型):

R_386_32:绝对地址形式,一般是S + A;R_386_PC32:PC 相对,一般是S + A - P;- 其中

S是符号地址,A是 addend,P是重定位入口地址。

- 其中

完成这一轮后:

- 目标文件里

.rel.text/.rel.data这类“静态重定位节”对最终可执行文件来说已经没用了, - 链接器一般会直接把它们丢掉,因此在

ET_EXEC/ET_DYN里通常看不到这些节(除非用特殊选项要求保留)。

对于静态链接程序(

-static):

绝大部分符号引用(包括 libc 等静态库里的函数)在这一步就被“彻底解决”,最终可执行文件里不再依赖外部符号。

对于动态链接程序(默认模式):

链接器只解决“自己能定死的”部分;

对需要在运行时由共享库提供的符号,会保留一部分“动态重定位任务”给动态链接器去做,相关信息会写入.dynsym/.dynstr/.rela.dyn/.rela.plt等节中。

生成运行时元数据

为了让内核 / 动态链接器 / 调试器能够正确装载、运行和分析这个 ELF,链接器还需要生成一堆“辅助结构”:

程序头表(Program Header Table)

- 若干

Elf*_Phdr条目,如PT_LOAD、PT_DYNAMIC、PT_INTERP等; - 告诉内核:文件中哪些区间要映射到内存哪里、权限是什么(R/W/X)。

- 若干

.interp/PT_INTERP(仅动态链接程序)- 里面是动态链接器路径,例如

/lib64/ld-linux-x86-64.so.2; - 让内核知道“启动这个程序前要先加载哪个解释器(动态链接器)”。

- 里面是动态链接器路径,例如

动态节

.dynamic/PT_DYNAMIC(动态链接相关)以

Elf*_Dyn数组的形式记录:- 依赖的共享库(

DT_NEEDED); - 动态符号表、字符串表的位置(

DT_SYMTAB/DT_STRTAB); - 动态重定位表的位置和大小(

DT_RELA*/DT_REL*); - 初始化 / 终止函数(

DT_INIT/DT_FINI/DT_INIT_ARRAY*/DT_FINI_ARRAY*)等;

- 依赖的共享库(

这些信息是动态链接器在运行时的“导航图”。

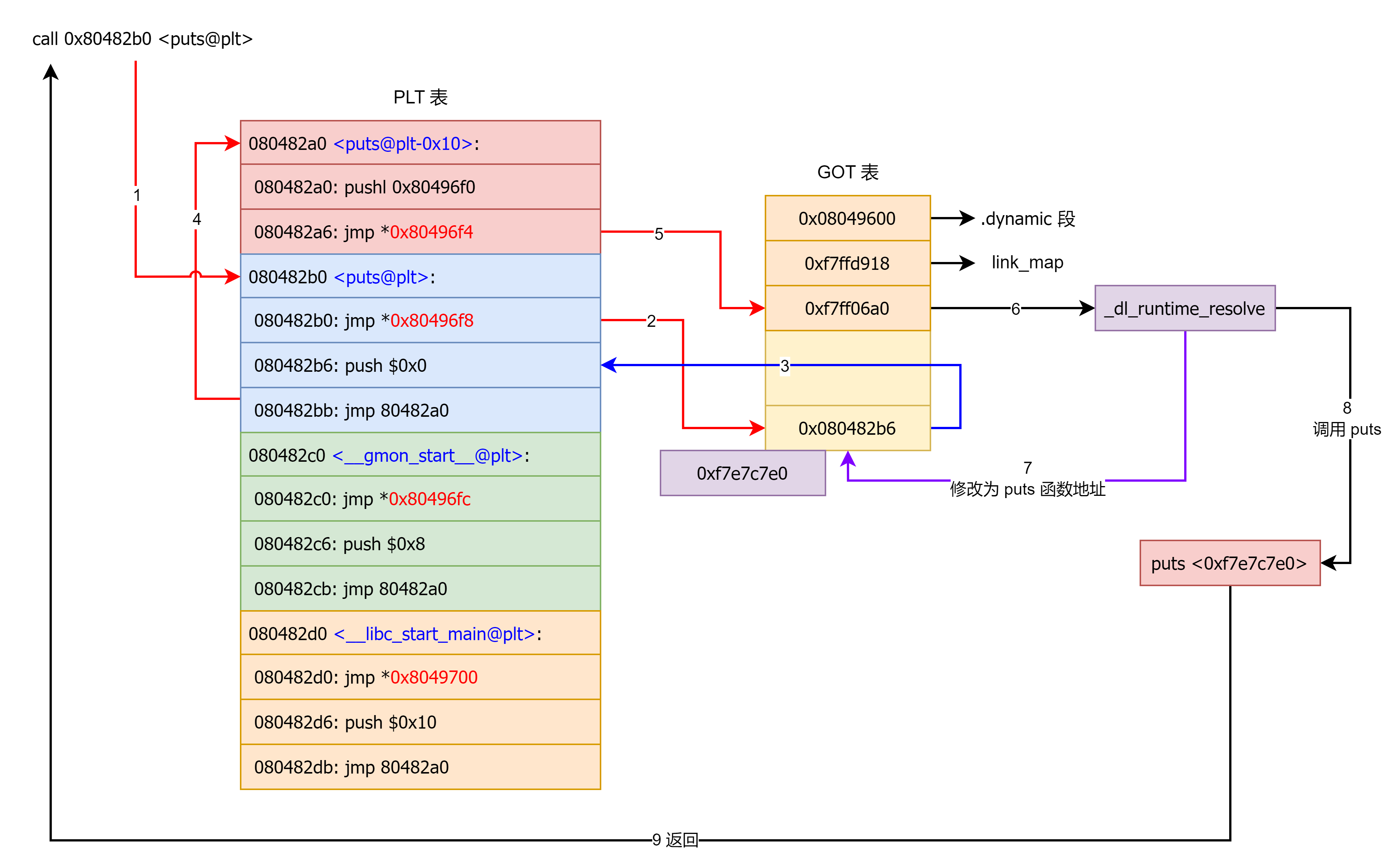

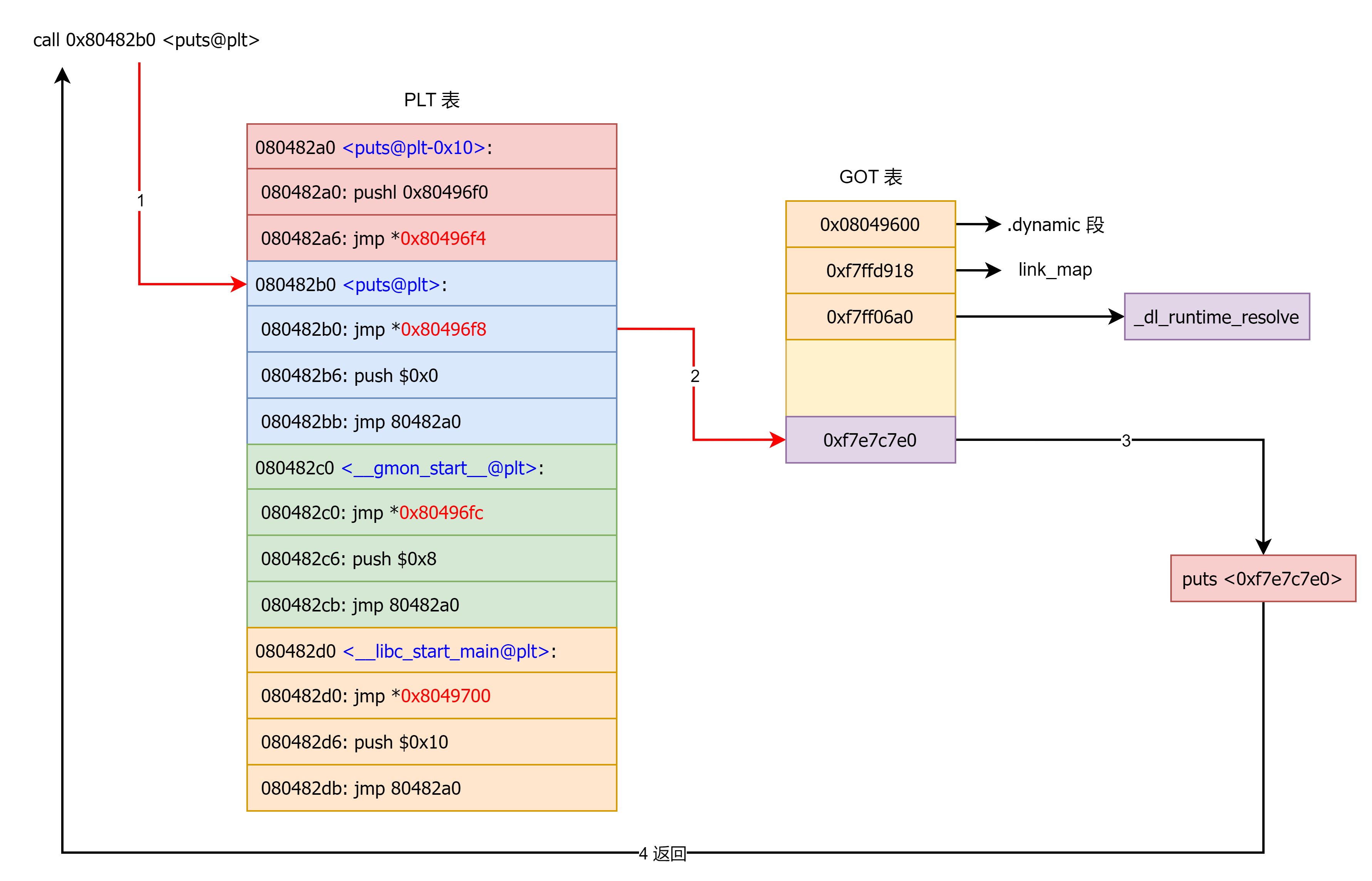

PLT / GOT(对动态链接程序)

为外部函数调用合成 PLT 代码段

.plt/.plt.sec和对应的 GOT 槽位.got.plt;在

.rela.plt/.rel.plt中为每个跳转槽位生成一个重定位条目,告诉动态链接器:- 第一次调用某个函数时应该如何解析符号、写入 GOT、并跳转过去;

- 或在 FULL RELRO +

-z now时一上来就把这些槽位填满。

程序执行过程

装载

在 Linux 中,装载(load/load in memory)指的是操作系统内核将一个 ELF 可执行文件从磁盘读取出来,并将其内容映射到进程的虚拟地址空间中,准备好让 CPU 可以从它的入口点开始执行的整个过程。

装载的本质是:内核清空当前进程的用户空间 → 加载新程序 → 设置入口 → 开始执行。

1 | 用户命令 → shell 调用 fork → 子进程调用 execve |

从 shell 到 execve

当我们在 shell 中执行一条命令时,实际上发生了以下流程:

bash进程调用fork()创建一个子进程;- 子进程调用

execve()执行新的 ELF 可执行程序; - 父进程继续执行,等待子进程结束。

其中 execve() 是 Linux 中非常核心的一个系统调用,简单来说,**execve() 就是“让当前进程去运行另一个程序”。**该函数原型如下:

1 | int execve(const char *pathname, char *const argv[], char *const envp[]); |

pathname:要执行的程序路径(可以是 ELF 文件、脚本等)argv[]:参数列表(传给main(int argc, char *argv[]))envp[]:环境变量列表

另外 glibc 提供了多个 exec 族 API(如 execl, execvp, execvpe 等)对其封装,最终都调用 execve()。

| 函数名 | 参数形式 | 是否查 PATH | 是否自带 envp | 调用示例 |

|---|---|---|---|---|

execl |

列表 | ❌ 否 | ❌ 否 | execl("/bin/ls", "ls", NULL); |

execlp |

列表 | ✅ 是 | ❌ 否 | execlp("ls", "ls", NULL); |

execle |

列表 + envp | ❌ 否 | ✅ 是 | execle("/bin/ls", "ls", NULL, envp); |

execv |

数组 argv[] |

❌ 否 | ❌ 否 | execv("/bin/ls", argv); |

execvp |

数组 argv[] |

✅ 是 | ❌ 否 | execvp("ls", argv); |

execvpe |

数组 + envp | ✅ 是 | ✅ 是 | execvpe("ls", argv, envp); |

提示

参数形式指的是怎么把参数(

argv)传给要执行的程序。列表形式指的是一个一个地写参数(就是函数的变长参数)。例如

execl:1

execl("/bin/ls", "ls", "-l", "/tmp", NULL);

这种形式里,函数的参数是分开的,最终内部会构造出一个

argv[]数组:1

char *argv[] = {"ls", "-l", "/tmp", NULL};

数组形式指的是需要自己先准备好一个

argv[]数组,把它直接传进去:1

2char *argv[] = {"ls", "-l", "/tmp", NULL};

execv("/bin/ls", argv);

是否查

PATH指的是系统要不要自动去$PATH环境变量指定的目录中查找可执行文件的位置。1

2

3execlp("ls", "ls", NULL); // ✅ 查 PATH,会找到 /bin/ls 或 /usr/bin/ls

execl("/bin/ls", "ls", NULL); // ❌ 不查 PATH,需要你手动给出完整路径在 Linux 中,环境变量

PATH是一串目录组成的列表,比如:1

2echo $PATH

# /usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin当你调用

execvp("ls", argv)时,它会依次在这些目录中查找有没有可执行文件叫"ls",直到找到为止。- 如果找到了,比如

/bin/ls,就用它去执行; - 如果没找到,就报错

ENOENT。

- 如果找到了,比如

是否自带

envp这个函数是否支持你传入自定义envp(不然只能用默认的)。envp是环境变量数组,是一个char *envp[]类型,例如:1

char *envp[] = {"PATH=/bin:/usr/bin", "USER=sky123", NULL};

- 如果函数 没有

envp参数,那就只能自动使用当前进程的环境变量(通过全局变量environ获取); - 如果函数 有

envp参数(比如execle,execvpe),你可以自己传一组新的环境变量数组,用于改变目标程序执行时的环境。

- 如果函数 没有

下面是一个简易的 bash 程序实现:

1 |

|

execve 的内核的实现

execve() 是 Linux 中最核心的“程序执行”系统调用。它会将当前进程的用户态空间完全清空,然后加载新的 ELF 程序及其依赖库,并最终跳转到新程序入口点执行。

execve 整体的系统调用流程如下:

1 | glibc // 用户态 C 库;调用 exec 系列 API |

简单来说 execve 的执行逻辑就是就是判断可执行文件的魔数然后调用对应的回调函数加载执行可执行文件。

魔数(Magic Number) 指文件头部的一段固定字节序列,用来快速标识文件类型或版本。它是“文件格式的身份证”,让操作系统或应用程序无需解析整个文件即可知道该用哪种解析/加载器处理。

例如在类 UNIX 操作系统中,文件头以

#!(称为 Shebang)开头,是专门用于标识“这是一个脚本文件”及其对应解释器路径的魔数格式。而对于 ELF 格式的可执行文件,其魔数是:

\x7FELF。

对于可执行文件,在 fs/binfmt_elf.c 中定义了加载执行该类型文件的回调函数 load_elf_binary。

1 | static struct linux_binfmt elf_format = { |

load_elf_binary() 是 Linux 内核真正把 ELF 映像搬进新进程地址空间并把 CPU 跳到入口地址的函数,该函数的主要逻辑为:

验证 ELF 头

- 检查魔数

\x7FELF、位宽、字节序、e_type(ET_EXEC/ET_DYN)。 - 读取并验证 Program‑Header Table 数量与大小。

- 检查魔数

查找

.interp段(如有)- 若存在

PT_INTERP,读出动态链接器路径/lib*/ld-linux*.so.*。 - 打开链接器文件,为后续映射做准备。

有

PT_INTERP的 ELF,其真正的“解释器”就是这个ld-linux*.so.*;跟#!/usr/bin/python3的脚本会交给 python 解释器,有点类似。1

./a.out arg1 arg2

内核等价于偷偷做了:

1

/lib64/ld-linux-x86-64.so.2 ./a.out arg1 arg2

你也可以自己手动这么干,比如:

1

2

3

4

5# 看看当前程序的解释器是谁

readelf -l ./a.out | grep 'interpreter'

# 手动调用动态链接器来跑它

/lib64/ld-linux-x86-64.so.2 ./a.out arg1 arg2前提是:

- 这个 ELF 是动态链接的(有

PT_INTERP); - 你用的路径要跟

.interp里的一致或兼容。

对于静态链接程序(没

PT_INTERP),就不会走动态链接器了,内核直接把它当普通ET_EXEC装载执行,用ld-linux.so去跑就没意义。- 若存在

加载 Program‑Header

PT_LOAD段- 逐段

mmap.text/.rodata/.data/.bss等到进程地址空间; - 计算

load_bias(PIE 随机基址)并更新start_code/end_code等 mm 统计字段; - 为

.bss/heap 调用set_brk()分配零页。

- 逐段

设置栈与辅助向量 (

setup_arg_pages()→create_elf_tables())- 把

argv[]、envp[]、auxv[]拷到新栈; - 在 auxv 填入

AT_PHDR,AT_ENTRY,AT_BASE,AT_RANDOM等,供链接器/程序读取。

- 把

加载并映射动态链接器(若存在)

load_elf_interp()把ld.so自身映射进地址空间;- 记录其加载基址,用作

AT_BASE及后续重定位。

切换到新进程映像

flush_old_exec()→ 清掉旧 mm;install_exec_creds()→ 安装新 UID/GID/LSM 凭据;- 随机化栈 / brk(若启用 ASLR)。

确定入口地址并启动线程

- 静态 ELF:入口 =

e_entry + load_bias; - **动态 ELF (PIE)**:入口 = 链接器入口;链接器完成重定位后再跳到主程序

_start; start_thread(regs, elf_entry, stack_top)把rip/eip指向入口并返回用户态。

- 静态 ELF:入口 =

一旦 start_thread() 返回到用户空间,CPU 已在 新程序入口 指令处运行;自此,旧进程代码与所有旧 .so 全部被替换。

进程虚拟地址空间

在现代操作系统中,每个进程都运行在自己的虚拟地址空间(Virtual Address Space)中。所谓虚拟地址空间,是操作系统提供给进程的一种抽象地址空间:

- 每个进程拥有独立的地址空间,互相隔离。

- 虚拟地址空间由连续的虚拟地址构成,而不是物理地址。

- 操作系统通过内存管理单元(MMU)将虚拟地址翻译为实际的物理地址。

虚拟地址空间让进程以为自己独占内存空间,简化了程序设计,并提高了系统的安全性和稳定性。

通常来说,一个进程(关闭 PIE 且动态链接)的进程空间布局如下:

1 | 0x0000_0000_0000 ── NULL page (不可访问,解引用触发 SIGSEGV) |

其中常见的段含义如下:

| 区域 / 段 | 典型权限 | 详细说明 |

|---|---|---|

.text |

R‑X |

- 代码段(text segment),包含可执行的 机器指令。- 在可执行文件中,此段往往是只读 + 可执行,避免被恶意篡改。- 如果启用了 NX(No-eXecute)保护,除了此段外,其他内存区域将被禁止执行(W^X 策略)。 |

.rodata |

R-- |

- Read-Only Data 段。- 存放 字符串常量、const 修饰的全局变量、C++ 的 虚表(vtable) 等。- 映射为只读,防止运行期间被意外或恶意修改。 |

.data |

RW- |

- 已初始化的全局变量、静态变量(.data段)。- 例如:int x = 42; 会被存入此区域。 |

.bss |

RW- |

- Block Started by Symbol(BSS 段),用于未初始化的全局 / 静态变量。- 比如:int y; 会占据此段空间。- 在加载时由内核自动用 0 填充,不会占用磁盘文件空间(仅占内存页)。 |

.got / .plt |

.got: RW-``.plt: R‑X |

- GOT(Global Offset Table) 保存运行时解析出的函数 / 全局变量地址。- PLT(Procedure Linkage Table) 是延迟绑定跳板,调用函数时会跳到 .plt 中间接跳转到实际地址。- 两者配合实现 dlopen() 和延迟绑定机制。 |

.dynamic |

R-- |

- 存放动态链接信息,如:符号表、重定位表偏移、需要的共享库名等。- 程序启动时由动态链接器(如 ld-linux.so)读取并处理。 |

.init_array / .fini_array |

RW- |

- 分别用于 C/C++ 程序的构造函数(初始化)和析构函数(结束)列表。- 编译器将 __attribute__((constructor)) 或全局对象构造函数地址放入 .init_array,在启动时自动调用。 |

| Heap(堆) | RW- |

- 程序通过 malloc() / new 等动态分配的内存区域。- 初始堆由 brk() 创建,超出部分通过 mmap() 生成匿名页。- 向高地址扩展。 |

| Stack(栈) | RW- |

- 包含函数调用栈帧、局部变量、返回地址等信息。- 默认 8MB 左右空间,可通过 ulimit -s 设置。- argv[], envp[], auxv[] 也在进程启动时由内核构造在此处。- 向低地址扩展;底部设置 guard page(不可访问)防溢出。 |

| vDSO / vvar | R-- |

- vDSO(Virtual Dynamic Shared Object)是内核映射到用户空间的共享库,提供 gettimeofday() 等系统调用的用户态实现,加快访问速度(免陷入内核)。- vvar 是 vDSO 访问的变量页,如时钟源信息。- cat /proc/self/maps 可见它们在栈附近。 |

| mmap() 区域 | R--/RW-/RWX 等 |

- 使用 mmap() 映射的所有区域:包括动态链接库(.so 文件)、匿名页、文件映射、JIT 编译代码区等。- 运行时由内核动态分配,段数量不定;常见于 JavaScript 引擎、Python、动态模块等。 |

进程栈的初始化

当我们执行:

1 | ls /home |

bash 最终会调用:

1 | execve("ls", argv, envp); |

从这一刻开始,内核接管控制权,大致流程(对 ELF 程序)是:

do_execveat_common()解析参数,识别这是 ELF。调用

load_elf_binary()(fs/binfmt_elf.c):- 释放旧地址空间,创建新的

mm_struct; - 映射 ELF 的

PT_LOAD段(代码段、数据段等); - 调用

setup_arg_pages()创建用户栈 VMA(这里会处理 ASLR + 栈/映射区间隔); - 调用

create_elf_tables()把argc/argv/envp/auxv布置到栈上; - 设置寄存器:指令指针(IP)= 入口地址、栈指针(SP)= 刚搭好的栈顶。

- 释放旧地址空间,创建新的

从内核返回用户态,从入口地址开始执行(静态程序直接是你的

_start,动态程序是ld-linux.so的_start)。

在 load_elf_binary() 中,内核先选一个靠近 STACK_TOP 的位置作栈顶:

1 | unsigned long stack_top = STACK_TOP; |

randomize_stack_top() 会在 STACK_TOP 附近向下随机偏移一段(典型范围是 ~8MB):

1 |

|

生成一个随机数

random_variable = get_random_int() & STACK_RND_MASK;random_variable <<= PAGE_SHIFT(按页对齐);对向下生长的栈,返回:

1

stack_top = PAGE_ALIGN(STACK_TOP) - random_variable;

这一步在 8MB 左右的范围内随机(

STACK_RND_MASK决定上限)。

接着,在 create_elf_tables() 里还会调用 arch_align_stack() 做一次细粒度随机 + 16 字节对齐:

1 | unsigned long arch_align_stack(unsigned long sp) |

这两步叠加效果:

- 每次

execve(),初始栈地址都不一样(ASLR); - 最终

%rsp会被对齐到 16 字节,满足 System V ABI 要求,所以你总能看到栈地址低 4 bit 为 0,但高几位总在变。

只做 ASLR 还不够。历史上 Linux 只有“一页 guard page”,结果出现了著名的 Stack Clash:用户栈可以一次性递归/alloc 大量空间,一口气“跳过”那一页,直接撞上 mmap 区,引起堆栈重叠,从而打穿沙箱。

为此,内核引入了一个全局参数 **stack_guard_gap**,表示栈和其它映射之间要预留多少页不映射(guard 区):

官方文档(Documentation/admin-guide/kernel-parameters.txt)说明:

stack_guard_gap=:距离主栈前(栈向下增长时)或后(栈向上增长时)预留多少页不用于映射,默认是 256 页。

在通用 mm 代码里,有两个辅助函数专门考虑这个 gap:

1 | static inline unsigned long vm_start_gap(struct vm_area_struct *vma) |

这些函数被 mmap 布局代码用来保证:在栈 VMA 周围预留一段 stack_guard_gap 大小的空洞,别的 VMA 不会贴得太近。

再看 top‑down mmap 布局(很多 64 位平台使用),mmap_base() 里会参考当前 RLIMIT_STACK 和 stack_guard_gap 计算 stack 与 mmap 之间的“安全间隔 gap”:

1 | static unsigned long mmap_base(unsigned long rnd, struct rlimit *rlim_stack) |

关键点:

gap 至少包含:

- 栈允许的最大大小(

RLIMIT_STACK); stack_guard_gap(例如缺省 256 页 ≈ 1MB 左右);- 外加考虑栈随机化的那一段。

- 栈允许的最大大小(

gap 被夹在

[MIN_GAP, MAX_GAP]之间,防止搞得太大或太小。mmap 顶端(

mmap_base)会在TASK_SIZE - gap之下,留出这个 gap 给栈增长和 guard 使用。

直观理解:

内核在用户栈和 mmap 区之间留出了一块至少

stack_guard_gap+ 随机偏移 + RLIMIT_STACK 的 “空洞”,栈要想撞上 mmap,必须先填满自己允许的栈大小,还得跨过 guard 空洞,Stack Clash 难度就被拉高很多。

栈空间搞定之后,create_elf_tables() 会在栈顶附近按 ELF 规范布置进程参数和“辅助信息”。

在程序初始状态的栈如下图所示:

pwndbg> stack 40

00:0000│ rsp 0x7fffffffdf28 —▸ 0x7ffff7c29d90 (__libc_start_call_main+128) ◂— mov edi, eax

01:0008│ 0x7fffffffdf30 —▸ 0x7fffffffe038 —▸ 0x7fffffffe3ba ◂— '/usr/bin/ls'

02:0010│ 0x7fffffffdf38 —▸ 0x555555558d10 ◂— endbr64

03:0018│ 0x7fffffffdf40 ◂— 0x2f7fa5910

04:0020│ 0x7fffffffdf48 —▸ 0x7fffffffe038 —▸ 0x7fffffffe3ba ◂— '/usr/bin/ls'

05:0028│ 0x7fffffffdf50 ◂— 0

06:0030│ 0x7fffffffdf58 ◂— 0xea1debf161b77c7f

07:0038│ 0x7fffffffdf60 —▸ 0x7fffffffe038 —▸ 0x7fffffffe3ba ◂— '/usr/bin/ls'

08:0040│ 0x7fffffffdf68 —▸ 0x555555558d10 ◂— endbr64

09:0048│ 0x7fffffffdf70 —▸ 0x555555574fd8 —▸ 0x55555555ab40 ◂— endbr64

0a:0050│ 0x7fffffffdf78 —▸ 0x7ffff7ffd040 (_rtld_global) —▸ 0x7ffff7ffe2e0 —▸ 0x555555554000 ◂— 0x10102464c457f

0b:0058│ 0x7fffffffdf80 ◂— 0x15e2140edfd37c7f

0c:0060│ 0x7fffffffdf88 ◂— 0x15e204745b3b7c7f

0d:0068│ 0x7fffffffdf90 ◂— 0x7fff00000000

0e:0070│ 0x7fffffffdf98 ◂— 0

... ↓ 3 skipped

12:0090│ 0x7fffffffdfb8 ◂— 0xea3da6237c5e9c00

13:0098│ 0x7fffffffdfc0 ◂— 0

14:00a0│ 0x7fffffffdfc8 —▸ 0x7ffff7c29e40 (__libc_start_main+128) ◂— mov r15, qword ptr [rip + 0x1f0159]

15:00a8│ 0x7fffffffdfd0 —▸ 0x7fffffffe050 —▸ 0x7fffffffe3cc ◂— 'SYSTEMD_EXEC_PID=1484'

16:00b0│ 0x7fffffffdfd8 —▸ 0x555555574fd8 —▸ 0x55555555ab40 ◂— endbr64

17:00b8│ 0x7fffffffdfe0 —▸ 0x7ffff7ffe2e0 —▸ 0x555555554000 ◂— 0x10102464c457f

18:00c0│ 0x7fffffffdfe8 ◂— 0

19:00c8│ 0x7fffffffdff0 ◂— 0

1a:00d0│ 0x7fffffffdff8 —▸ 0x55555555aaa0 ◂— endbr64

1b:00d8│ 0x7fffffffe000 —▸ 0x7fffffffe030 ◂— 2

1c:00e0│ 0x7fffffffe008 ◂— 0

1d:00e8│ 0x7fffffffe010 ◂— 0

1e:00f0│ 0x7fffffffe018 —▸ 0x55555555aac5 ◂— hlt

1f:00f8│ 0x7fffffffe020 —▸ 0x7fffffffe028 ◂— 0x1c

20:0100│ 0x7fffffffe028 ◂— 0x1c

21:0108│ 0x7fffffffe030 ◂— 2

22:0110│ rsi r12 0x7fffffffe038 —▸ 0x7fffffffe3ba ◂— '/usr/bin/ls'

23:0118│ 0x7fffffffe040 —▸ 0x7fffffffe3c6 ◂— 0x595300656d6f682f /* '/home' */

24:0120│ 0x7fffffffe048 ◂— 0

25:0128│ rdx 0x7fffffffe050 —▸ 0x7fffffffe3cc ◂— 'SYSTEMD_EXEC_PID=1484'

26:0130│ 0x7fffffffe058 —▸ 0x7fffffffe3e2 ◂— 'SSH_AUTH_SOCK=/run/user/1000/keyring/ssh'

27:0138│ 0x7fffffffe060 —▸ 0x7fffffffe40b ◂— 'SESSION_MANAGER=local/ubuntu:@/tmp/.ICE-unix/1452,unix/ubuntu:/tmp/.ICE-unix/1452'

pwndbg> telescope &environ 1

00:0000│ 0x7ffff7ffe2d0 (environ) —▸ 0x7fffffffe050 —▸ 0x7fffffffe3cc ◂— 'SYSTEMD_EXEC_PID=1484'

pwndbg> vmmap 0x7fffffffe050

LEGEND: STACK | HEAP | CODE | DATA | WX | RODATA

Start End Perm Size Offset File (set vmmap-prefer-relpaths on)

0x7ffff7ffd000 0x7ffff7fff000 rw-p 2000 39000 /usr/lib/x86_64-linux-gnu/ld-linux-x86-64.so.2

► 0x7ffffffde000 0x7ffffffff000 rw-p 21000 0 [stack] +0x20050

从低地址到高地址的大致布局(低地址 = 初始 %rsp 指向的位置):

以 ls /home 为例:

argc = 2(一般为argv[0] = "/usr/bin/ls",argv[1] = "/home");argv是一个以 NULL 结尾的指针数组,数组元素指向后面“字符串区”的具体 C 字符串;envp同理,是以 NULL 结尾的char *数组,例如:1

2

3envp[0] -> "SYSTEMD_EXEC_PID=1484"

envp[1] -> "SSH_AUTH_SOCK=/run/user/1000/..."

...

C 运行时里全局变量 char **environ 一般就直接指向 envp[0]。

辅助信息数组(Auxiliary Vector)是内核给用户态“塞的一小包元数据”。内核在进程启动时,会在用户栈上布置一段

(a_type, a_val)形式的辅助向量 auxv,用来向用户态传递 ELF 布局、硬件特性、随机种子、UID/GID 等信息。

- 对 动态链接程序,动态链接器(

ld-linux.so)会优先读取其中的AT_PHDR、AT_PHNUM、AT_BASE、AT_ENTRY等条目,用来完成重定位和把控制权交给真正的程序入口。- 对 静态链接程序,没有动态链接器参与,但 libc 和应用本身仍然可以通过

getauxval()或/proc/self/auxv读取 auxv(如页大小、硬件能力、随机种子等)。以 32 位为例(64 位只是字段宽度不同),

Elf32_auxv_t的定义如下(节选自elf.h):

2

3

4

5

6

7

8

9

10

11

{

uint32_t a_type; /* Entry type */

union

{

uint32_t a_val; /* Integer value */

/* We use to have pointer elements added here. We cannot do that,

though, since it does not work when using 32-bit definitions

on 64-bit platforms and vice versa. */

} a_un;

} Elf32_auxv_t;其中

a_un是一个联合体,目前实际上只用到其中的a_val成员:

在 32 位结构体里是

uint32_t,在 64 位结构体里是 64 位无符号整型;从“语义”上看,它可能代表两类东西:

- 普通整数:比如

AT_PAGESZ、AT_FLAGS等;- 地址值:比如

AT_PHDR、AT_BASE、AT_ENTRY、AT_RANDOM、AT_EXECFN等,本质是一个指针,被强行塞进整型里。

a_type指示这一条 auxv 的类型,决定了a_val的含义。常见类型包括:

AT_NULL (0)

辅助向量列表结束标志。最后一条一定是(AT_NULL, 0)。

AT_IGNORE (1)

忽略此条目,历史兼容保留,一般不用。

AT_EXECFD (2)

可执行文件的文件描述符(配合fexecve()等使用)。多数普通execve(path, ...)的程序不会设置。

AT_PHDR (3)

程序头表(Program Header Table)在内存中的地址。动态链接器用它来遍历Elf*_Phdr,找到PT_PHDR、PT_DYNAMIC等段。

AT_PHENT (4)

程序头表中每个条目的大小(字节数),通常是sizeof(Elf*_Phdr)。

AT_PHNUM (5)

程序头表中条目的数量,对应 ELF 头里的e_phnum。

AT_PAGESZ (6)

系统页大小(如 4096)。libc/malloc/动态链接器会用它做页对齐和内存映射。

AT_BASE (7)

动态链接器自身的装载基址(比如/lib64/ld-linux-x86-64.so.2在进程地址空间中的基地址)。

对纯静态程序通常为 0。

AT_FLAGS (8)

各种标志位,含义依具体实现和 ABI,一般调试器/动态链接器内部使用。

AT_ENTRY (9)

程序入口点虚拟地址(最终要跳到的地址),和 ELF 头的e_entry一致(考虑装载基址后)。

AT_NOTELF (10)

标记“原始执行文件不是标准 ELF”,某些兼容场景用,一般 ELF 程序不会碰到。

AT_UID/AT_EUID/AT_GID/AT_EGID

程序的真实/有效 UID、GID,libc、PAM、沙箱等可能会用。

AT_SECURE

非 0 表示当前进程处于“安全执行模式”,例如 setuid 程序。libc 会据此忽略部分不安全的环境变量。

AT_RANDOM

指向栈上一块 16 字节的随机数据。glibc 用它初始化栈 canary、rand()种子等安全相关内容。

AT_EXECFN

指向启动该程序时使用的路径字符串(通常是argv[0]对应的那一块)。注意:并不是每个进程都会拥有所有这些条目,内核会根据实际情况填充一部分,剩下的根本不会出现。

这些值的“解释”由 libc / 动态链接器负责,你在 glibc 里可以通过

getauxval(AT_XXX)读到。

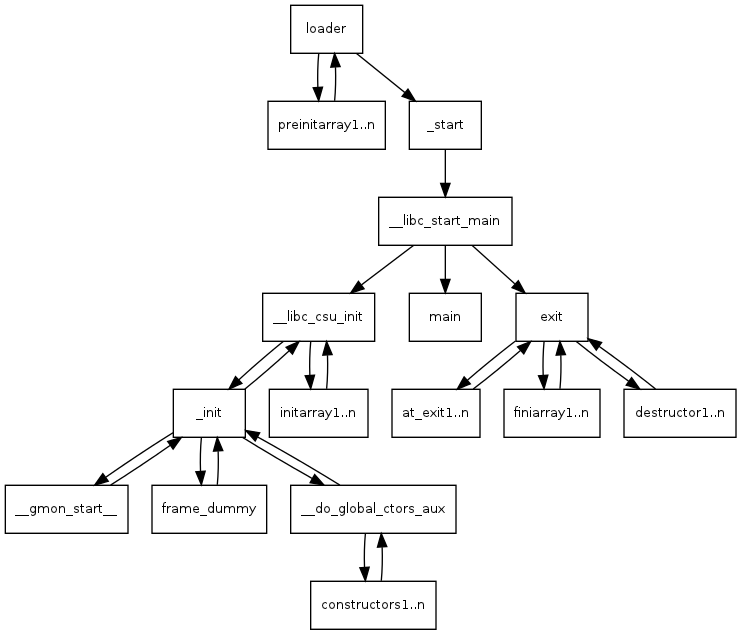

内核把 IP/SP 设好后,开始执行用户态入口:

- 静态链接程序:IP 直接指向你的

_start; - 动态链接程序:IP 指向

ld-linux.so的_start,它先处理自己的重定位、扫描 auxv、构建链表link_map等,然后再跳到目标 ELF 的_start。

以 glibc + x86‑64 为例,你的程序里的 _start(crt1.S)做的事情大致是:

1 | ENTRY (_start) |

_start先从栈里弹出argc,算出argv指针:popq %rsi→rsi = argcmov %rsp, %rdx→rdx = argv

and $~15, %rsp,直接把%rsp底 4 bit 清零,强制对齐到 16 字节边界。内核把

argc/argv/envp/auxv布好栈,把控制权交给_start,此时栈不一定是满足 SysV ABI 要求的 16 字节对齐(内核只保证基本合理性和自己的对齐策略)。这一步保证

__libc_start_main这类 C 函数被调用时,栈已经按 x86‑64 SysV ABI 要求对齐好了。紧接着

pushq %rax、pushq %rsp等,最后再call __libc_start_main。1

__libc_start_main(main, argc, argv, init, fini, ..., stack_end);

__libc_start_main() 里会

设置全局变量

environ = envp;从 auxv 提取

AT_*信息,完成 TLS / canary / locale 等初始化;调用构造函数(

.init_array);最后才调用用户的:

1

return main(argc, argv, envp);

动态链接

动态链接(Dynamic Linking)是指把“某些符号的解析和重定位工作”推迟到程序装载时甚至运行时再做:

可执行文件里只记录“我需要哪些共享库、哪些导入符号”;

程序启动时由 动态链接器(

ld-linux.so) 根据.dynamic/.dynsym/.rela.*等信息:- 把各个共享对象(

.so)映射进内存; - 解析导入符号;

- 对 GOT/数据等做动态重定位;

- 然后把控制权交给程序入口。

- 把各个共享对象(

在 ELF 的动态链接里,有两个核心限制:

- 代码要支持 位置无关(共享库、PIE),指令里不能写死绝对地址;

- 可执行文件在链接阶段还不知道外部函数/变量最终会来自哪个

.so,地址要到运行时由动态链接器决定。

于是就出现了两张表:

- GOT(Global Offset Table):纯数据表,存“将来要用到的各种地址”(变量地址、函数地址等);

- PLT(Procedure Linkage Table):纯代码表,存“调用外部函数用的跳板 stub”。

基本模式:

代码 → 跳到 某个 PLT 入口 → 通过 GOT 槽位 找到目标地址 → 真正的函数 / 变量。

这样:

编译/链接时,代码里只需要写相对地址(PC-relative)到 PLT/GOT;

运行时动态链接器填补 GOT,PLT 就能通过 GOT 间接跳转到真正的实现;

可以支持:

- 共享库复用;

- PIE;

- lazy binding 等。

ELF 相关结构

.interp 段

在需要“程序解释器”的 ELF 可执行文件中(典型就是动态链接的可执行文件,包括 PIE),通常会有一个名为 .interp 的 节(section)。

- 节名:

.interp - 一般类型:

SHT_PROGBITS,带SHF_ALLOC标志 - 通常会被映射到一个 程序头(Program Header),类型为

PT_INTERP的段(segment)

注意:ELF 规范里 关键的是

PT_INTERP这个 Program Header,.interp只是实现上常见的节名而已。

.interp 的内容非常简单:

- 内容是一段 以

\0结尾的 ASCII 字符串 - 这段字符串给出的是 “程序解释器(Program Interpreter)”的路径

- 在 Linux 上,绝大多数情况下,这个解释器就是 动态链接器(dynamic linker / loader)

常见(但不是唯一正确)的例子:

- x86_64 + glibc:

/lib64/ld-linux-x86-64.so.2 - i386 + glibc:

/lib/ld-linux.so.2 - musl libc:如

/lib/ld-musl-x86_64.so.1等

所以,**不能说 .interp 里“就是” /lib64/ld-linux-x86-64.so.2**,

应该说:

.interp中保存着一个以\0结尾的路径字符串,指定该 ELF 需要的“程序解释器”(在 Linux 上通常是动态链接器),路径具体取决于架构和发行版。

从内核视角看,关键是 程序头表中的 PT_INTERP 条目:

当你

execve()一个 ELF 文件时,内核解析其 Program Header Table:如果发现有一个

PT_INTERP条目:- 读取其中的路径字符串(文件偏移一般指向

.interp的内容) - 把该路径对应的 ELF 文件(通常是动态链接器,如

ld-linux-*.so.*)加载到内存 - 让这个“解释器”接管原始可执行文件的装载和运行

- 读取其中的路径字符串(文件偏移一般指向

如果 **没有

PT_INTERP**:- 内核直接把当前 ELF 当作不需要外部解释器的程序加载执行(在常见场景下就是“静态链接程序”)

从工具和实践角度看:

- 带

PT_INTERP的 ELF 一般就是“动态链接的可执行文件(包括 PIE)” - 没有

PT_INTERP的,则一般是静态链接的可执行文件

- 带

更严谨地说:

- “是不是动态链接程序”的判断,核心依据是 是否存在

PT_INTERP(以及通常也有PT_DYNAMIC);.interp只是保存路径字符串的那块数据区域,内核真正关心的是指向它的PT_INTERPprogram header,而不是“有没有一个名叫.interp的节”。

.dynamic 段

在使用动态链接的 ELF 可执行文件或共享对象(共享库)中,有一个非常关键的结构:

**Dynamic Section(动态节) .dynamic**。

- 从 节(Section) 的角度看:名字就叫

.dynamic。 - 从 段(Segment) 的角度看:程序头表中有一个类型为

PT_DYNAMIC的段,它指向这块区域。

动态链接器(ld.so)真正依赖的是这个PT_DYNAMIC段 来找到.dynamic中的内容。

.dynamic 里存放的是一系列“键值对式”的条目,告诉动态链接器:

- 依赖了哪些共享库;

- 动态符号表和字符串表在哪里;

- 重定位表在哪里、多大;

- 初始化 / 终止函数在哪里;

- 以及其他动态链接需要的各种参数。

.dynamic 区域是一个以 Elf*_Dyn 为元素的数组,以 DT_NULL 结尾。

以 32 位为例(你原来的结构体是对的,只是 64 位略有不同):

1 | /* Dynamic section entry. */ |

64 位版本(简化)大致是:

1 | typedef struct { |

含义:

d_tag:表明这一项是什么类型(DT_XXX)。d_un.d_val/d_un.d_ptr:对于“一般整数值”的条目,用

d_val;对于“地址(虚拟地址)”类型的条目,用

d_ptr。d_ptr一般是虚拟地址,不是文件偏移;

最后一项是

d_tag == DT_NULL,表示.dynamic结束。